-

Microsoft의 AI 전략 분석 - 에너지에서 토큰까지 (25.11.17)TechStock&Review/AI&Cloud&SW 2025. 11. 17. 09:52

Microsoft's AI Strategy Deconstructed - From Energy to Tokens (Microsoft의 AI 전략 분석 - 에너지에서 토큰까지)

"The Big Pause", AI 토큰 팩토리 경제 스택, OpenAI, Neocloud 임대, GitHub Copilot, MAI 및 Maia

Microsoft는 2023년과 2024년 AI 분야 선두를 달렸지만, 1년 전 완전히 방향을 바꿨습니다.

데이터센터 건설을 크게 중단하고 OpenAI에 대한 투자도 늦췄습니다.

https://spedtrder.tistory.com/21마이크로소프트 데이터센터 동결 과 전략의 변화 (25.5.1)

마이크로소프트 데이터센터 동결 - 1.5GW 자체 건설 속도 둔화 및 리스 취소 에 대한 오해지난 몇 달 동안 마이크로소프트의 데이터센터 임대 활동 축소에 대한 우려를 제기하는 여러 기사가 보도

spedtrder.tistory.com

2025년은 OpenAI가 Microsoft에서 벗어나 다각화에 나서는 해였으며, Oracle, CoreWeave, Nscale, SB Energy, Amazon, Google 등이 모두 OpenAI와 대규모 컴퓨팅 계약을 직접 체결했습니다.

심각한 상황처럼 보입니다. 오늘 저희는 Microsoft의 실수를 분석하는 게시물과 함께, 사티아 나델라와 우리의 소중한 친구 드와르케시 파텔과의 공개 인터뷰를 통해 그들의 AI 전략과 실행 방식에 대해 질문했습니다.

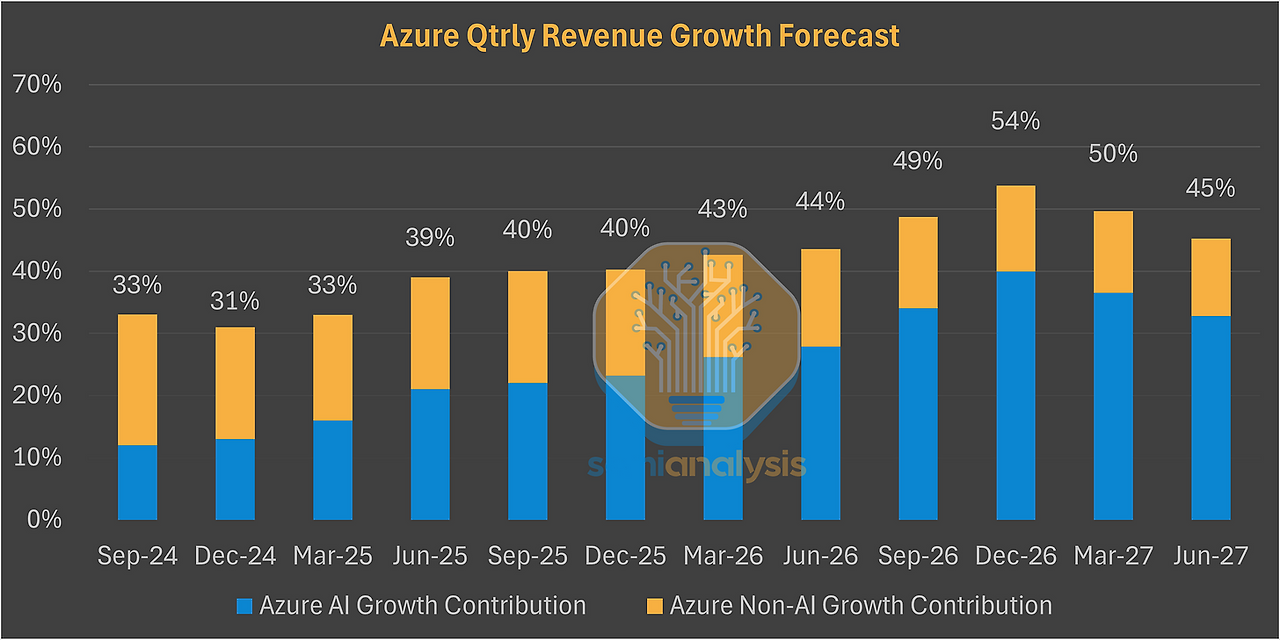

이제 Microsoft의 AI 투자가 다시 시작되었고, 이 AI 거대 기업은 가속 컴퓨팅에 대한 수요가 그 어느 때보다 높았습니다. Redmond의 거물 Microsoft는 잘못된 방향으로 가고 있음을 깨닫고 획기적으로 방향을 전환했습니다. 새롭게 발표된 OpenAI 인수를 통해 Azure의 성장은 토큰이코노믹스 모델에서 예측한 대로 향후 분기에 가속화될 것으로 예상됩니다.

Microsoft는 AI 토큰 경제 스택의 모든 부분에서 활동하고 있으며, 급속한 성장을 목격하고 있으며, 이러한 추세는 앞으로도 몇 분기와 몇 년 동안 지속될 것으로 예상됩니다.

역자주: MSFT Other Inference/Traing 매출이 2Q25 대비 감소한것 Microsoft의 현재 상황을 보여주는 것 같습니다.

회사는 단기 용량 확보를 적극적으로 모색하고 있으며, 확보 가능한 모든 방안을 강구하고 있습니다. 자체 구축, 임대, Neocloud, 외딴 지역 등 단기 용량 증가를 가속화하기 위한 모든 방안을 검토하고 있습니다.

하드웨어 측면에서 Microsoft는 현재 개발 중인 가장 흥미로운 맞춤형 칩 ASIC인 OpenAI의 커스텀 칩 IP에도 접근할 수 있습니다.

OpenAI의 ASIC 개발 궤적이 Microsoft Maia ASIC 칩보다 훨씬 나아 보인다는 점을 고려하면, Microsoft가 결국 이 칩을 사용하여 OpenAI 모델을 지원할 가능성이 있습니다. 이러한 상황은 Microsoft가 OpenAI 모델에 대해 처한 상황을 반영합니다. Microsoft는 OpenAI 모델에 접근할 수 있지만, 여전히 Microsoft AI를 사용하여 자체 기반 모델을 학습시키려 하고 있습니다. 우리는 Microsoft가 진정한 수직 통합 AI 강자로 거듭나기 위해 노력하고 있으며, 대부분의 서드파티 매출 총이익 스택을 제거하고 경쟁사보다 더 낮은 비용으로 더 많은 인텔리전스를 제공하려 한다고 생각합니다.

역자주: Microsoft는 Mustafa Suleyman (구글 DeepMind 설립자, 현 Microsoft AI 총괄) 주도 AI 부서, 인력 확충 및 자체 모델 훈련 목표로 진행중이며 OpenAI와 협력관계가 느슨해지면서 자체 개발로 방향을 전환한 것으로 보이며 다른 빅테크 (구글, 아마존, 메타) 대비 방향전환으로 늦은감이 없지 않아 있습니다.

https://newsletter.semianalysis.com/p/openai-chip-team-is-now-seriousOpenAI Chip Team Is Now Serious

Poaching Aggressively

newsletter.semianalysis.com

이 보고서에서는 Microsoft AI 사업의 모든 측면을 심층적으로 살펴봅니다. 먼저 OpenAI와의 협력 관계를 살펴보며, 2023년부터 2024년까지 Microsoft의 데이터센터 투자가 급증한 역사적 배경과 수십 MW에서 기가와트급으로 급증한 OpenAI 훈련 클러스터 규모를 다룹니다. 이어서 "큰 휴식기"와 데이터센터 시장으로의 극적인 복귀를 분석합니다. 이러한 변화는 OpenAI 소유 구조의 대폭적인 간소화와 더불어, Microsoft가 상태 비저장 API를 통해 모델 기능을 제품 사용 사례(및 수익)로 전환하는 데 필요한 인프라를 제공하는 데 집중한 데서 비롯되었습니다.

역자주: 참고로 25년 11월 11일 SoftBank 어닝콜에서 엔비디아 주식을 전부 매도하고 OpenAI 지분 약 $22.5bn 을 투자하게 됨에 따라 SoftBank 는 약 11% 지분율을 보유하게 됩니다. 다만 Microsoft의 OpenAI 지분은 27% 로 고정됩니다. OpenAI Foundation의 지분 증가(36%)로 비영리 통제권이 강화되어 Microsoft의 의사결정 영향력이 약화될 수 있습니다. 또한, Softbank의 컴퓨팅 자원 공급 확대(2030년까지 75%)로 Microsoft의 Azure 의존도가 줄어들 위험이 있습니다.

그런 다음 AI 토큰 경제 스택에서 Microsoft의 포지셔닝을 모두 분석합니다.- 애플리케이션

- LLM

- PaaS

- IaaS

- 칩

- 시스템 아키텍처

각 섹션에서는 Microsoft의 제품 포트폴리오, 경쟁적 포지셔닝 및 전망을 심층적으로 살펴보겠습니다. 소프트웨어 거대 기업인 Microsoft가 지배적인 생산성 제품군과 AI 컴퓨팅 플랫폼에 수많은 신규 진입자와 도전자들을 마주하고 있는 상황에서, 이러한 상황이 Microsoft에게 항상 좋은 소식만은 아닙니다.Microsoft & OpenAI in 2023-25: From All-In on AI to the Big “Pause” ( 2023-25년의 Microsoft와 OpenAI: AI에 대한 모든 것에서 대규모 "일시 정지"까지)

2023-24: selfbuild, leasing, and building the world’s largest datacenters for OpenAI (2023-24: OpenAI를 위한 세계 최대 규모의 데이터 센터 자체 구축, 임대 및 구축)

2022년 11월 ChatGPT 출시는 세상을 바꿨습니다. Microsoft는 "ChatGPT 시대"에 가장 먼저 대응한 하이퍼스케일러였으며, 그 대응은 놀라웠습니다. Microsoft는 2019년 OpenAI에 10억 달러를 투자했지만, 2023년 1월에는 투자액을 10배로 늘렸습니다. 동시에, Microsoft는 핵심 AI 파트너를 중심으로 역사상 가장 공격적인 데이터센터 확장을 단행했습니다.

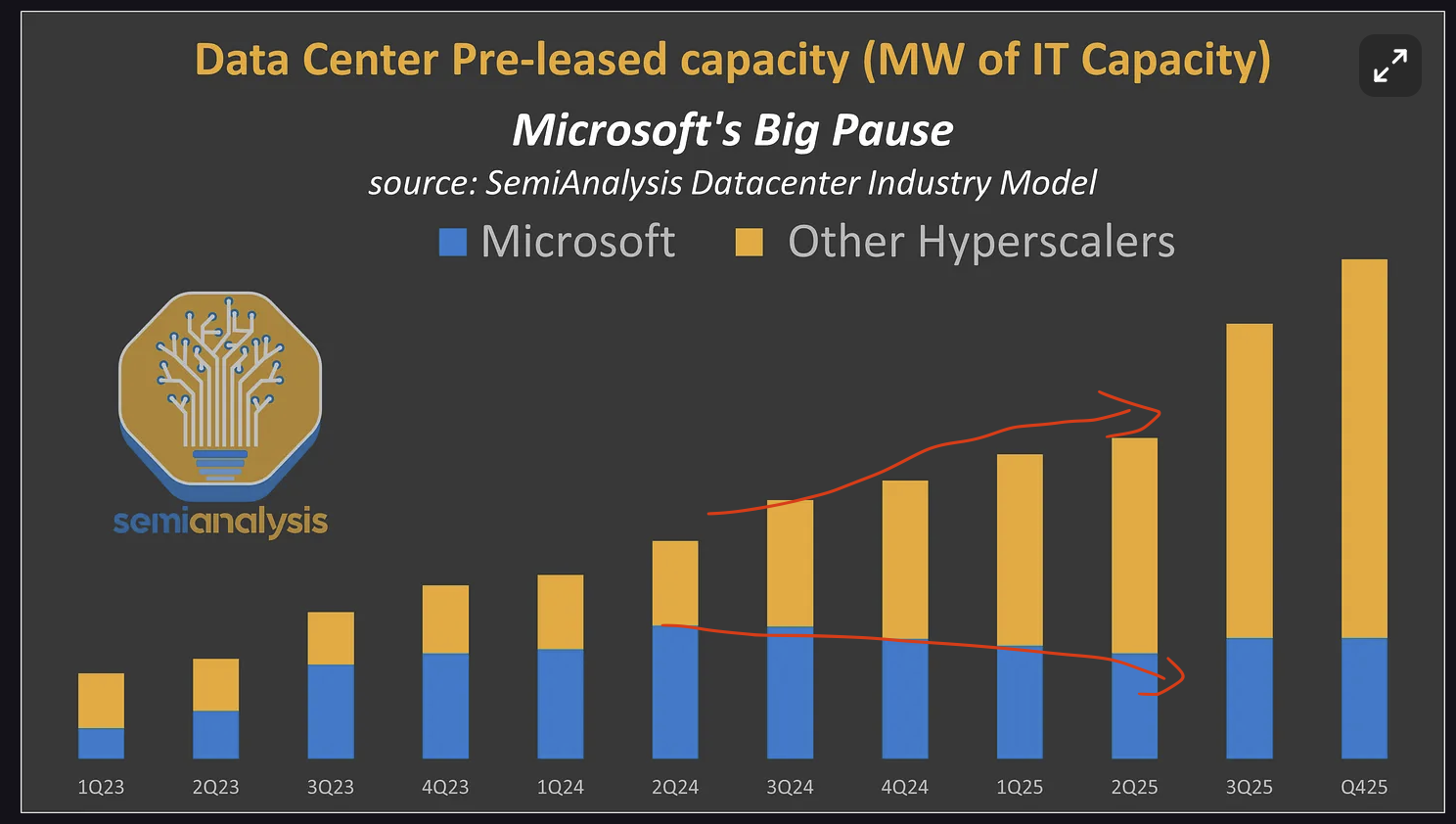

아래 차트는 용량 증가 및 CapEx를 보여주는 가장 중요한 선행 지표 중 하나인 데이터센터 사전 임대 활동을 보여줍니다. 2023년 1분기부터 2024년 2분기까지 Microsoft의 사전 임대 활동은 다른 하이퍼스케일러 기업들의 총 임대량을 크게 웃돌았습니다. 2023년 3분기에 Microsoft는 단독으로 2022년 전체 북미 시장 임대량과 거의 비슷한 규모의 임대를 기록했습니다.

데이터센터 임대는 전체 그림의 일부에 불과합니다. 당사의 건물별 데이터센터 산업 모델은 2024년과 2025년 동안 자체 구축 용량이 메가와트(MW) 단위로 전례 없는 속도로 증가했음을 보여줍니다. 또한, 코어위브(Coreweave)와 오라클(Oracle)로부터 추가 용량 확보를 위한 수십억 달러 규모의 계약을 체결했습니다.Microsoft & OpenAI training clusters – from a fraction of a building to the world’s largest facility (Microsoft 및 OpenAI 교육 클러스터 – 건물의 일부부터 세계 최대 규모의 시설까지)

아마도 이 확장의 가장 상징적인 상징은 "Fairwater" 프로그램일 것입니다. 2023-24년에 Microsoft는 지구상에서 가장 큰 두 개의 데이터센터를 계획하고 동시에 건설했습니다. Microsoft의 2023-24년 확장 규모를 간략히 살펴보기 위해 과거로 돌아가 보겠습니다. 아래는 아이오와에 위치한 첫 번째 주요 훈련 클러스터로, GPT 3.5가 훈련된 곳입니다. 약 2만 5천 개의 A100 칩이 설치된 것으로 추정됩니다. 아래 캠퍼스는 상당히 넓지만, OpenAI는 Ballard 빌딩 한 곳의 데이터 홀 두 개, 즉 약 19MW만 사용하는 것으로 추정됩니다.

두 번째 주요 클러스터는 애리조나에 건설되었습니다. 시간이 지남에 따라 건물을 하나씩 증축하여 2023년에 첫 번째 H100 건물이 완공되었고, 2024년에는 별도 시설에 H200이, 2025년에는 GB200을 호스팅하는 두 개의 데이터센터가 추가로 완공되었습니다. 총 4개 건물에 약 13만 개의 GPU가 설치된 것으로 추산됩니다.

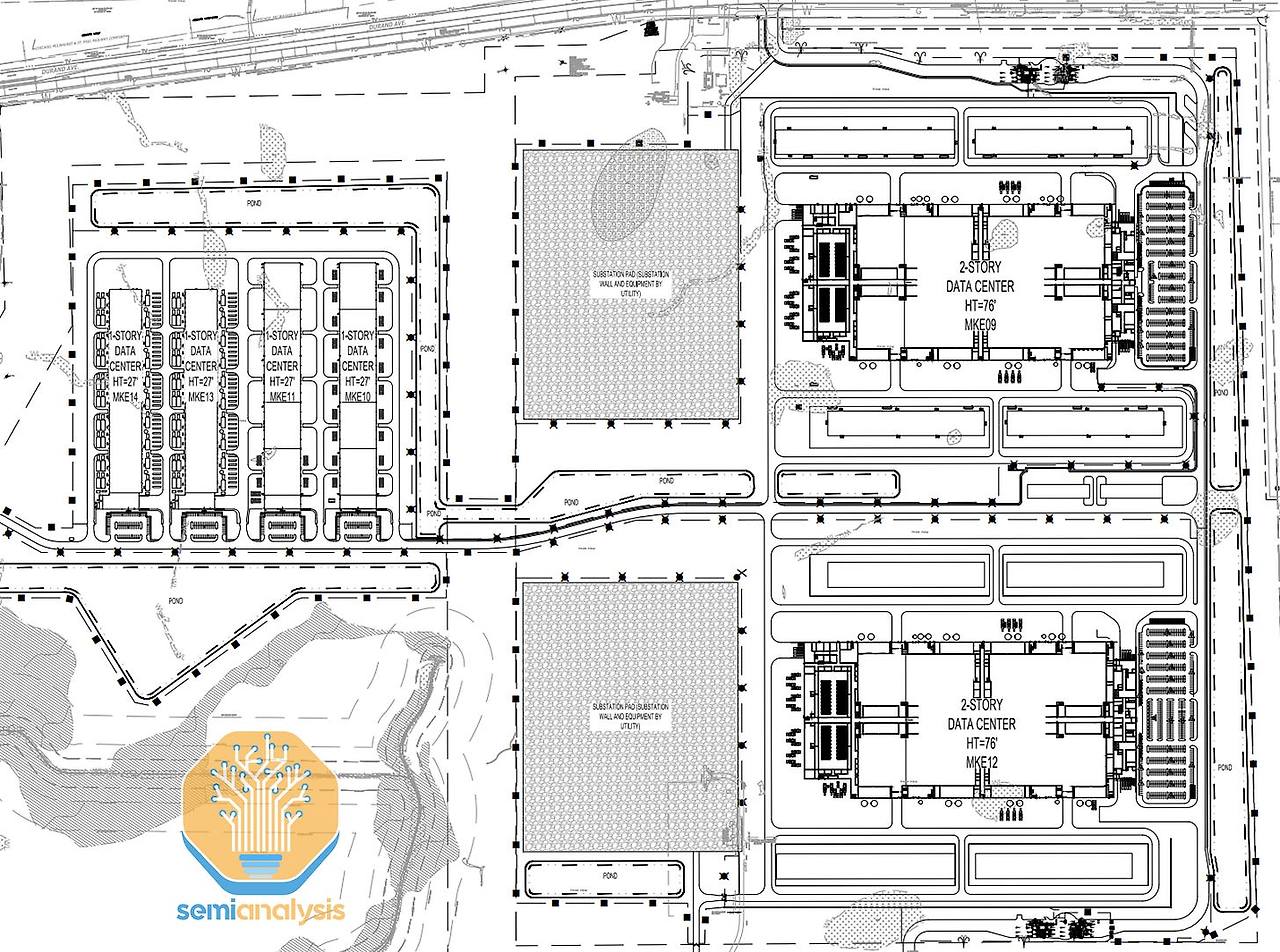

Microsoft의 OpenAI용 차세대 클러스터는 "Fairwater" 라고 불리며 훨씬 더 큽니다. 각 "Fairwater"는 두 개의 건물로 구성되어 있습니다. 48MW의 표준 CPU 및 저장 시설과 초고밀도 GPU 건물입니다. 2층 건물에 총 약 80만 제곱피트(약 78만 제곱미터) 면적의 초고밀도 GPU 건물은 약 300MW의 전력을 소비하는데, 이는 미국 20만 가구가 소비하는 전력량과 같습니다. 이는 건물당 15만 GB200 GPU가 넘는다는 것을 의미합니다. 아래는 OpenAI 전용 위스콘신 시설입니다.

조지아주에 QTS는 Microsoft를 위해 "자매" 시설을 건설했는데, 이 시설 역시 OpenAI를 위한 것입니다. 냉각 시스템은 다르지만, GPU 건물 역시 약 300MW 규모입니다. 아래 사진은 이 시설의 규모를 보여줍니다. 전 세계 어떤 건물도 이만큼 많은 공랭식 냉각기를 냉각용으로 갖추고 있지 않습니다! 현장 변전소의 규모 또한 인상적입니다.

https://epoch.ai/data/data-centers/satellite-explorer/MicrosoftFayettevilleGeorgiaMicrosoft Fayetteville - Frontier Data Centers Satellite Explorer

See how satellite imagery, permits, and public disclosures are used to track the power capacity and performance of frontier data centers.

epoch.ai

개별 건물들은 지구상에서 가장 클 뿐만 아니라, 그보다 더 큰 캠퍼스에 자리 잡고 있습니다. 애틀랜타에서는 두 번째 "Fairwater" 가 이미 건설 중입니다.

위스콘신에서는 두 번째 Fairwater 데이터센터가 곧 착공될 예정이지만, Microsoft가 더 큰 규모의 3단계 데이터센터를 준비하고 있어 더 많은 이야기가 있습니다. Microsoft는 600MW 이상의 개별 건물 두 채를 설계했으며, 각 건물은 표준 300MW 페어워터 데이터센터보다 두 배 많은 CPU/스토리지와 디젤 발전기를 갖추고 있는 것으로 보입니다. 아래는 이 600MW 건물들의 부지 배치도입니다. 이 건물들이 예정대로 완공된다면 세계 최대 규모의 개별 데이터센터가 될 것입니다.

Microsoft Fairwater - Frontier Data Centers Satellite Explorer

See how satellite imagery, permits, and public disclosures are used to track the power capacity and performance of frontier data centers.

epoch.ai

완전히 구축되면 2GW가 넘는 IT 용량을 갖춘 세계 최대 규모의 캠퍼스 중 하나가 될 것입니다.

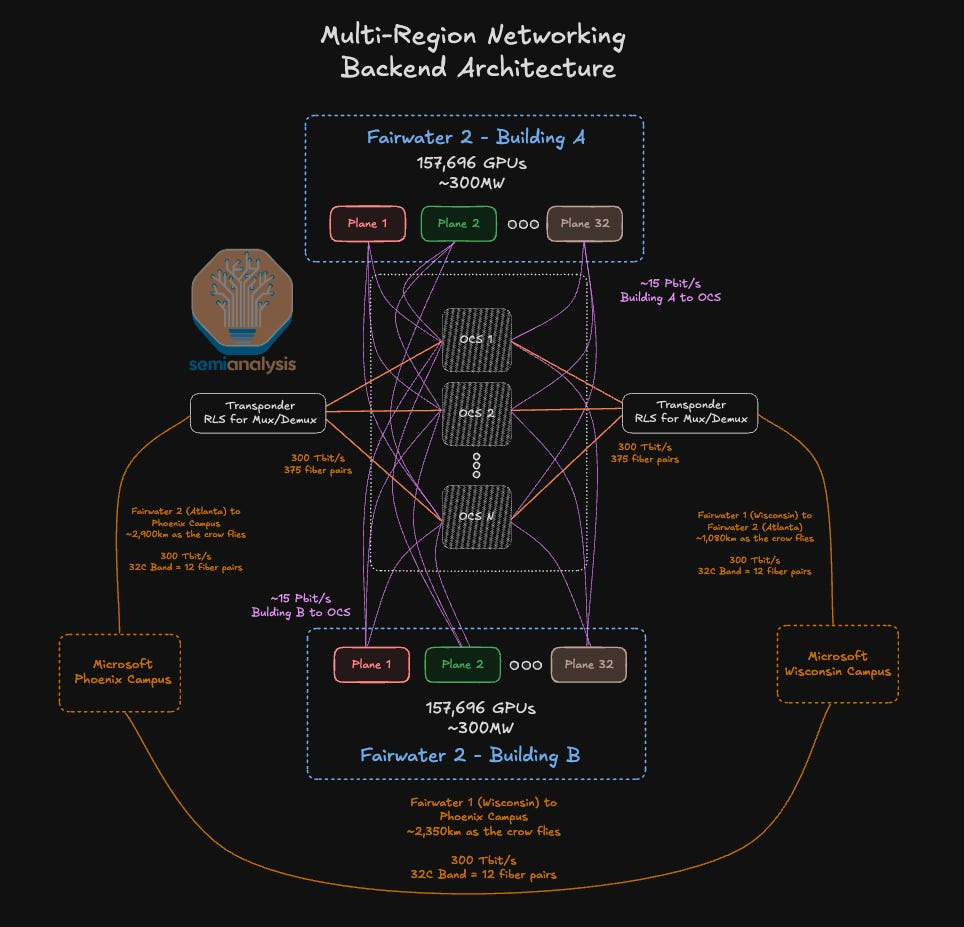

덤으로, Microsoft는 이 모든 주요 AI 지역을 300Tb/s 이상의 초고속 AI WAN을 통해 연결하고 10Pb/s 이상으로 확장할 수 있도록 계획했습니다. 저희는 1년 전 "멀티 데이터센터 훈련: 구글 인프라를 뛰어넘기 위한 OpenAI의 야심 찬 계획"이라는 글에서 이를 언급했습니다.

https://newsletter.semianalysis.com/p/multi-datacenter-training-openaisMulti-Datacenter Training: OpenAI's Ambitious Plan To Beat Google's Infrastructure

Gigawatt Clusters, Telecom Networking, Long Haul Fiber, Hierarchical & Asynchronous SGD, Distributed Infrastructure Winners

newsletter.semianalysis.com

아래에는 가상의 5GW 분산 클러스터에 대한 네트워크 설계를 표현했습니다. AI 네트워킹 모델을 기반으로 Fairwater 네트워킹 아키텍처의 모든 측면에 대해서는 보고서 후반부에서 자세히 설명하겠습니다.

The Multi-Gigawatt “pause” - 멀티 기가와트 "일시 정지"

모든 실린더에 시동을 건 후, Microsoft는 갑자기 브레이크를 밟기로 결정했습니다. 놀라운 방식으로 말입니다. 전체 데이터센터 사전 임대 잔액을 살펴보면, Microsoft만 최대 임대 계약의 60% 이상을 차지했습니다! 그러나 2024년 2분기(달력 기준) 이후 신규 임대 활동이 정체된 반면, 다른 하이퍼스케일러들은 상당히 회복세를 보였습니다. Microsoft의 현재 하이퍼스케일러 사전 임대 용량은 전체의 25% 미만입니다.

당시 Microsoft는 다음과 같은 여러 지역에서 수 기가와트 규모의 비구속적 의향서(LOI)를 철회했습니다.- 피닉스와 시카고 등 주요 미국 시장

- 영국과 북유럽을 포함한 주요 유럽 시장

- Microsoft의 중단은 호주, 일본, 인도, 그리고 라틴 아메리카 지역에 영향을 미쳤습니다.

이러한 사이트들은 오라클, 메타, 코어위브, 구글, 아마존 등 다른 주요 경쟁사들로 이전되었습니다. Microsoft는 AI에 대한 무관심과 불신으로 인해 AI 인프라의 상당 부분을 영원히 포기했습니다.

또한, Microsoft는 자체 구축 프로그램도 상당히 축소했습니다. 아래 사진을 보면 약 950MW의 "동결"된 IT 용량을 확인할 수 있습니다. 여기에는 버지니아, 조지아, 애리조나를 비롯한 전 세계 여러 곳의 다른 데이터 센터는 포함되지 않았습니다.

같은 기간 동안 다른 업체의 주요 데이터센터는 초기 단계에서 운영 중인 워크로드로 전환되었습니다. Microsoft는 2028년까지 구축될 예정이었던 3.5GW 이상의 용량을 일시 중단했습니다.Microsoft’s AI portfolio decomposed: IaaS, PaaS, Models, Applications (Microsoft의 AI 포트폴리오 분해: IaaS, PaaS, 모델, 애플리케이션)

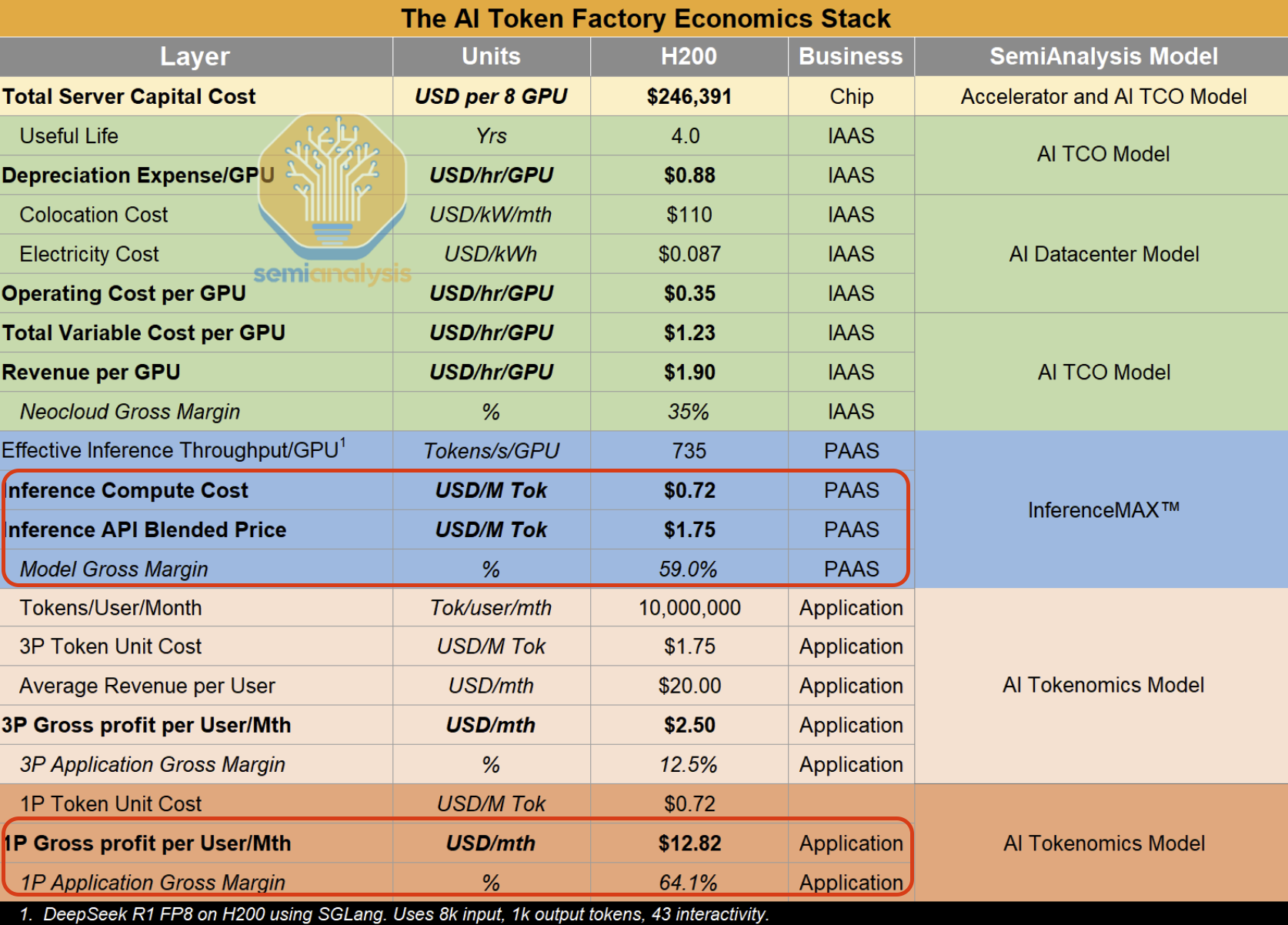

Big Pause 의 원인과 결과를 이해하기 위해 Microsoft AI 포트폴리오의 모든 부분을 자세히 살펴보겠습니다. 각 계층의 마진을 분석하기 위해 저희가 선호하는 프레임워크는 "AI 토큰 팩토리 경제 스택"입니다.

- 칩부터 토큰까지, 다양한 공급업체가 AI 인프라 구축에 노출되어 있습니다.

- 현재 가장 큰 마진 스택은 물론 Nvidia의 75% GPM에 의해 주도되는 칩 레벨입니다.

- 다음 네 계층의 최종 마진 프로필에 대한 격렬한 논쟁이 여전히 진행 중입니다.

- 애플리케이션 계층(예: ChatGPT, Microsoft Copilot, Claude Code 등)

- 모델 계층(예: Claude 4.5 Sonnet, GPT5-Pro, DeepSeek R1 등)

- IaaS 계층(예: Coreweave가 Meta에 베어 메탈 GPU 클러스터를 임대하는 경우, Oracle이 OpenAI에 GPU를 임대하는 경우, Nebius가 멀티테넌트 클러스터의 SLURM과 K8s를 스타트업에 임대하는 경우 등)

- PaaS 계층(예: AWS가 Bedrock을 통해 Fortune 500 기업에 토큰을 판매하는 경우, Nebius가 SLURM과 K8s를 사용하는 스타트업에 GPU 클러스터의 일부를 판매하는 경우 등)

역자주: 구글 GCP 의 경우 Vertex AI 가 PaaS 계층에 해당하고 주 고객은 Anthropic Claude 가 해당 서비스를 이용하고 있다.

오늘날의 현재 가격으로는 주요 모델 제작자들이 직접 API 사업에서 60% 이상의 마진을 얻는 것을 볼 수 있습니다.

Azure’s AI Bare Metal services – stepping away from $150B of OpenAI Gross Profit dollars, poor execution and ROIC concerns (Azure의 AI 베어 메탈 서비스 - OpenAI 매출 총이익 1,500억 달러에서 벗어나고 실행 부진 및 ROIC 우려)

대규모 베어 메탈 GPU/XPU 클러스터 구축 업계에서 성공한 기업들은 대규모 인프라 구축 기술을 완벽하게 갖추고 있습니다. 이는 실행 속도, 시장 및 최종 사용자 요구 사항에 대한 이해, 부지 선정, 자금 조달 등 다양한 요소들의 조합으로 이루어집니다.

Oracle 에 대한 심층 분석에서는 시장 장악을 위한 오라클의 중대한 전략적 변화를 지적했습니다. 기술 대기업을 제외하면, Coreweave 는 초기 규모는 작았지만 위의 기준을 완벽하게 충족하며 시장을 장악한 대표적인 사례입니다. 이제 Microsoft의 실행 사례를 살펴보겠습니다.

Disappointing execution, loss of the Stargate contract - 실망스러운 실행, 스타게이트 계약 상실

Microsoft의 베어메탈 관련 노력을 가늠하려면 페어워터 프로젝트를 면밀히 살펴보는 것이 좋습니다. 2024년 초, Microsoft의 OpenAI를 위한 1,000억 달러 규모의 "스타게이트" 프로젝트에 대한 소문이 돌았습니다. 위스콘신 데이터센터 캠퍼스에 클러스터를 호스팅할 계획이었던 것으로 추정됩니다. 앞서 언급했듯이, 로드맵에 따르면 해당 사이트는 2GW 이상의 용량을 확보할 예정이었습니다.

물론, 첫 번째 스타게이트 1,000억 달러 규모의 계약은 결국 Oracle 과 텍사스주 애빌린에 돌아갔습니다. Microsoft의 느린 실행 속도가 핵심적인 역할을 했다고 생각합니다. 착공 후 2년이 넘었지만, 1단계는 아직 가동되지 않고 있습니다. 반면 Oracle 은 2024년 5월 텍사스주 애빌린 데이터센터 착공을 시작하여 9월부터 운영을 시작했습니다.

https://epoch.ai/data/data-centers/satellite-explorer/OpenAIOracleStargateAbileneTexas

OpenAI Stargate Abilene - Frontier Data Centers Satellite Explorer

See how satellite imagery, permits, and public disclosures are used to track the power capacity and performance of frontier data centers.

epoch.ai

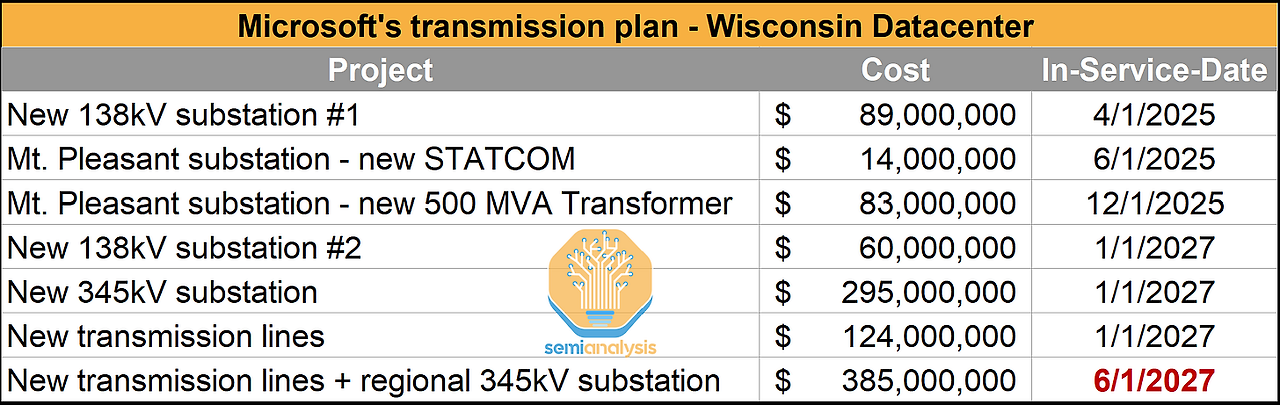

또한 Microsoft가 1.5GW 확장을 제대로 계획하지 못했다고 생각합니다. 전력 송전 관점에서 볼 때, 전체 용량은 오라클의 애빌린 클러스터가 1GW를 돌파한 지 1년 후인 2027년 중반에야 공급될 예정입니다. Microsoft는 OpenAI의 최대한 빠른 확장 요청을 따라잡지 못했는데, 이는 시장에 대한 오해를 보여주는 것입니다. Microsoft는 단기 컴퓨팅에 대한 끝없는 요구를 충족시킬 다른 파트너를 찾을 수밖에 없었습니다.

Stepping away from $150B of OpenAI Gross Profits (OpenAI 총 이익 1,500억 달러에서 멀어지다)

오늘날 우리가 알고 있듯이, Oracle은 OpenAI의 주요 GPU 파트너가 되었습니다. 지난 12개월 동안 4,200억 달러 이상의 계약 규모를 체결했으며, 이는 약 1,500억 달러의 매출 총이익으로 환산됩니다.

일반적인 5년 계약 기간을 고려할 때, 300억 달러의 연간 매출 총이익은 Microsoft의 1,940억 달러(2025 회계연도) 연간 매출 총이익을 18% 이상 증가시켰을 것입니다. 공정하게 말하자면, OpenAI 계약 손실은 단순히 계약 이행의 문제만은 아닙니다. 어느 정도는 의도적인 결정이기도 합니다. Microsoft의 관점에서 볼 때, 모든 OpenAI 계약을 체결하는 것은 Azure 사업의 질을 저하시켰을 것입니다. 그 이유는 다음과 같습니다.- OpenAI는 몇 년 안에 Azure 매출의 거의 50%를 차지했을 것입니다.

- 마진과 자본 수익률(ROC)은 Azure의 과거 클라우드 프로필만큼 매력적이지 않습니다.

Microsoft의 전체 사업과 비교했을 때, 오라클 AI ROIC는 20%로, 현재 Microsoft 전체의 35~40%에 비해 상당히 낮습니다. 그러나 2030년에서 2032년 사이에 종료될 예정인 OpenAI의 매출 점유율을 제외하면 Microsoft의 AI ROIC는 Oracle의 ROIC보다 크게 높지 않습니다.

하지만 Microsoft는 베어 메탈 워크로드 기반 AI 수익 구조에서 API 및 토큰 팩토리 중심의 비즈니스 모델로 전환하면서 최근의 역사적 교훈을 잊고 있는 듯합니다. 그 결과, 투자 수익률(ROIC)이 지속적으로 상승했습니다. 하지만 경쟁사가 AI 팩토리 사업에 진출할 수 있도록 자금을 지원한 셈입니다!

Underestimating demand, RPO share loss, desperate need for Neocloud capacity (수요 과소평가, RPO 점유율 손실, Neocloud 용량에 대한 절실한 필요성)

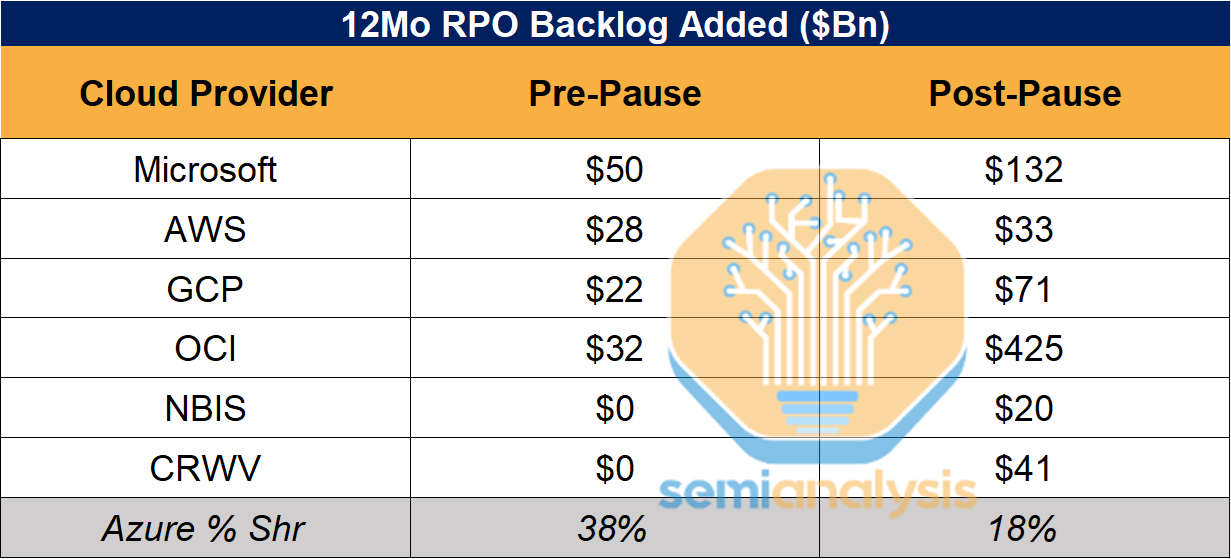

Microsoft의 일시정지 사태에서 얻은 중요한 교훈은 메타(Meta)와 같은 다른 업체들이 발생시키는 XPU 클라우드 수요 규모를 얼마나 과소평가했는지입니다. 우리는 현재 그들의 잘못된 계산이 미치는 영향을 목격하고 있습니다. 다른 업체들은 Microsoft보다 훨씬 더 많은 RPO를 확보하고 있습니다.

Microsoft는 이제 시장으로 확실히 복귀했지만, 단기적인 용량 확장 방안이 고갈되고 있습니다. 결국 최악의 선택, 즉 Neoclouds에서 GPU를 임대하여 베어 메탈이나 Foundry를 통한 토큰 형태로 제3자에게 재판매하는 방법을 선택해야 합니다. Foundry에 대해서는 아래에서 자세히 설명하겠습니다. 물론, 베어 메탈을 임대하여 재판매하는 사업은 Azure의 마진을 평소보다 상당히 낮게 만들 것입니다.

Microsoft는 자체 DC를 구축하는 것을 꺼렸고, 실패했다는 것을 깨닫고 나서 네오클라우드에 마진을 지불했습니다.

PaaS layer – Not All GPUs Are Deployed Equally (PaaS 계층 – 모든 GPU가 동일하게 배포되는 것은 아닙니다.)

Gold-rated cloud… at risk of downgrade (골드등급 클라우드…강등 위기)

올해 3월에 출시된 ClusterMAX 1.0에서 Azure는 네트워킹 성능, 보안, 최신 GPU 가용성 측면에서 선두를 달리고 있으며, OpenAI 컴퓨팅 구축에서 이미 상당한 점유율을 확보하고 있다고 설명했습니다. 이로 인해 Azure는 CoreWeave 바로 뒤를 이어 Nebius, Oracle, Crusoe와 같은 기업과 나란히 OpenAI 순위에서 Gold 티어에 속하게 되었습니다. 그러나 11월 초 ClusterMAX 2.0이 출시될 무렵, AI 워크로드를 타겟으로 하는 새로운 CycleCloud 및 AKS 기능 개발 속도가 정체된 것이 분명해졌습니다.

OpenAI, Meta, Snowflake, Cursor와 같은 확장형 AI 기업부터 Periodic Labs, AdaptiveML, Jua, Nous Research, DatologyAI, Cartesia와 같은 스타트업까지 140개 이상의 컴퓨팅 구매자와 이야기를 나눈 결과, Azure는 관리형 클러스터 또는 온디맨드 VM 분야에서 주요 업체가 아니라는 점이 분명해졌습니다.

Azure의 대규모 클러스터용 GPU 용량은 OpenAI로 바로 이전되는 듯하며, 남은 자원은 Fortune 500에 속한 기존 기업의 개별 개발자들이 차지하고 있습니다. RAG 챗봇 개발을 선호하는 이러한 기업들은 일반적으로 모든 IaaS를 Azure에서 독점적으로 구매하기 위한 기업 계약을 체결하고 있습니다.

https://newsletter.semianalysis.com/p/clustermax-20-the-industry-standardClusterMAX™ 2.0: The Industry Standard GPU Cloud Rating System

95% Coverage By Volume, 84 Providers Rated, 209 Providers Tracked, 140+ Customers Surveyed, 46,000 Words For Your Enjoyment

newsletter.semianalysis.com

Azure가 AI용 관리형 슬러름(Slurm)이나 쿠버네티스(Kubernetes) 클러스터를 판매하지 않는 이유는 직접 테스트하는 동안 명확해졌습니다. CycleCloud 슬러름 클러스터의 사용 편의성, 모니터링, 안정성, 그리고 상태 점검 측면에서 상당한 차이가 발견되었기 때문입니다. Azure가 OpenAI에 제공하는 도매 베어 메탈 경험은 CoreWeave, Nebius, Fluidstack과 같은 공급업체가 최종 사용자에게 제공하는 경험과는 매우 다릅니다.

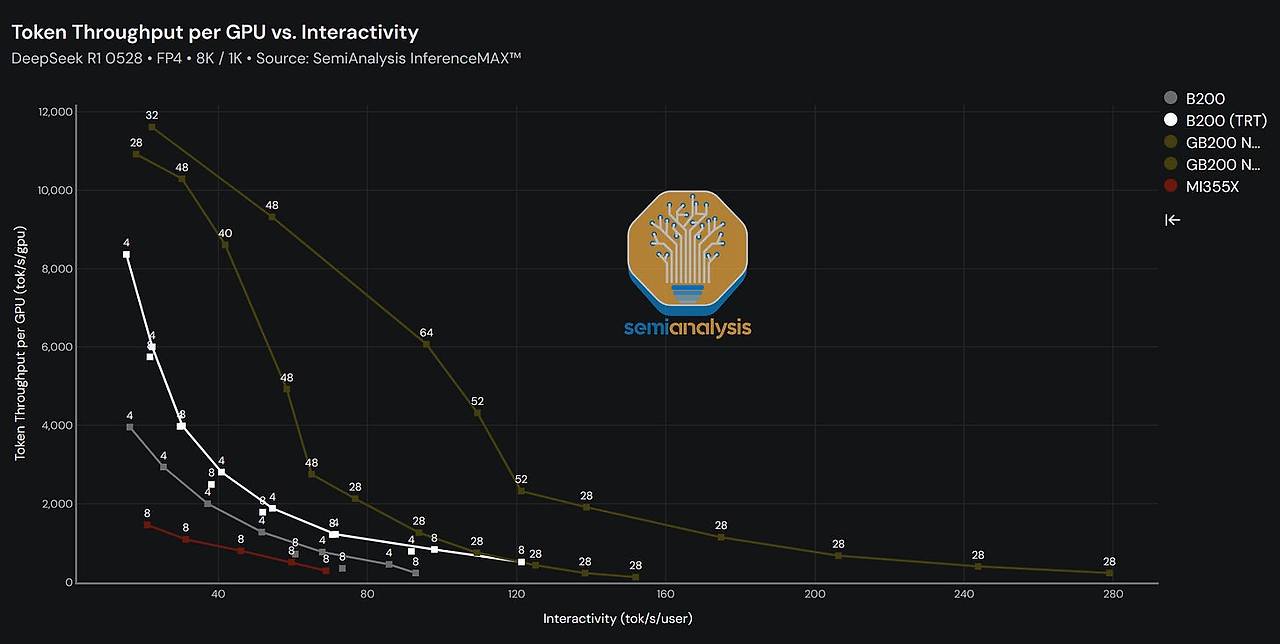

업계의 일반적인 GPU 컴퓨팅 구매자는 여전히 64~8,000개 GPU 규모의 H100, H200, B200 또는 B300 HGX 서버를 찾고 있습니다. AMD의 GPU 혹은 GB200, GB300 등을 찾는 구매자는 훨씬 드뭅니다. 그러나 Microsoft는 최대 고객(OpenAI)을 위해 AMD GPU와 GB200/GB300 NVL72 랙 스케일 시스템에 막대한 시간과 관심을 투자해 왔습니다. 엔지니어 급여에 대한 운영 비용(OPEX)이나 GPU 구매 및 신규 시설에 대한 자본 비용(CAPEX)으로 이를 측정할 수 있습니다.

이를 확인하는 또 다른 방법은 오픈 소스 커뮤니티를 활용하는 것입니다. 모든 기업이 오픈 소스 모델을 게시하고 다운로드하는 사실상의 플랫폼인 Hugging Face에 따르면, Microsoft와 관련된 IP는 Amazon에 비해 일일 모델 다운로드 수가 5배, Google에 비해 3배 적습니다.

Microsoft는 OpenAI 사업을 밀어냈지만, 그렇다고 해서 대기업이나 롱테일 시장을 장악하고 있는 것은 아닙니다. 이 지표에서 Microsoft는 다른 하이퍼스케일러에 비해 상당히 뒤처져 있습니다.

이 모든 것의 결과는 명확합니다. 적극적으로 용량을 확보하려는 AI 기업들은 다른 곳을 찾고 있습니다. 이는 약 100만 달러 규모의 1년 64개 GPU 계약부터 5억 달러 이상의 3년 8,000개 GPU 계약까지 다양합니다. 3월에 H100 256대를 구매했던 스타트업들이 11월에 NVL72 300GB 9,000대를 구매하려는 움직임을 보이고 있습니다. 현재 Azure는 이러한 모든 이점을 놓치고 있습니다.

이러한 고객 기반을 충족하기 위해 Azure는 AI용 CycleCloud 및 AKS 솔루션을 개편하여 현재 클러스터 배포 및 모니터링 환경을 간소화해야 한다고 생각합니다.

Azure는 상태 점검 기능을 구축하고, 이를 클러스터에 기본적으로 배포하며, 하드웨어 장애 발생 시 사전에 복구해야 합니다. 또한 GTM(Global Time Management)을 구축하고, 이러한 클러스터를 최종 사용자에게 제공할 인력으로 구성된 지원 조직을 구축해야 합니다.

ClusterMAX 2.0에서 언급했듯이, Azure는 시리즈 A부터 AI 유니콘 기업에 이르기까지 스타트업에게 열악한 사용자 경험을 제공하여 실버 등급으로 강등될 위험이 있습니다.

“Fungible fleet” and Sovereign AI – a bet on the direction of inference workloads ("대체 가능한 함대"와 Sovereign AI - 추론 워크로드 방향에 대한 베팅)

Azure는 분명 성공 기반을 갖추고 있습니다. 전 세계 70개 지역에 400개 이상의 데이터 센터를 운영하고 있으며, 미국 정보기관을 위한 "Azure Government Secret"부터 중국 소비자를 위한 Windows PC까지 전 세계 최대 규모의 기업에 판매 경험을 바탕으로 역대 최대 규모의 SaaS 사업을 운영하고 있습니다.

Azure 전략의 핵심은 광범위한 지리적 입지를 확보하여 기업 고객에게 AI를 더욱 가까이 제공하는 것입니다. 이는 AI 워크로드의 미래 모습을 예측하는 중요한 지표입니다.- 오늘날 가장 큰 추론 사용 사례인 ChatGPT와 코딩 에이전트는 지연 시간에 민감하지 않으며, 시간이 지남에 따라 점점 더 민감해질 것입니다. 또한 대부분의 경우 민감한 엔터프라이즈 데이터와 상호 작용하지 않습니다. 따라서 지연 시간과 데이터 지역성은 그다지 중요하지 않습니다. 핵심은 전 세계에 더 많은 토큰을 판매하기 위해 최대한 빠르게 용량을 늘리는 것입니다.

- 앞으로 엔터프라이즈 사용 사례는 성장의 큰 원동력이 될 것으로 예상됩니다. 이러한 사용 사례는 높은 보안, 데이터 지역성 법률, 그리고 대기업이 선호하는 일반적인 환경 및 제약 조건을 준수해야 합니다. 또한 특정 Azure 지역의 Cosmos DB 스토리지와 같이 AI가 아닌 워크로드와 함께 처리될 것입니다. 단점은 전 세계 대부분의 주요 대도시에 영향을 미치는 전력 제약으로 인해 데이터 센터 위치 선정 프로세스가 더 복잡하다는 것입니다. 과도한 전력을 사용하는 "외딴" 지역에 구축하는 다른 사용 사례에 비해 빠르게 용량을 늘릴 수 없습니다.

글로벌 입지를 구축하고 활용하는 것은 Microsoft의 "대체 가능한" 함대 구축이라는 핵심 목표의 핵심입니다. Microsoft는 이미 어느 정도 성공을 거두었습니다. 예를 들어 ByteDance Seed는 중국이나 말레이시아가 아닌 미국 애리조나에서 비디오 모델을 학습합니다.

ByteDance Seed는 미국 내 모든 주요 하이퍼스케일러로부터 자금을 조달하고 있다고 생각합니다. 이번 테스트는 경쟁사에서 진행되었지만, 어느 정도 대체 가능성이 필요하지 않다는 것을 보여줍니다.

이러한 인프라 전략은 OpenAI와 같은 주요 AI 연구소의 전략과는 상당히 다릅니다. 가장 전력 소모가 큰 워크로드(예: 심층 연구, 추론 모델)는 응답하는 데 몇 분이 걸리므로, 몇 밀리초의 네트워킹 지연 시간이 추가되는 것은 이러한 워크로드에 아무런 의미가 없습니다.

AI 작업의 시간적 범위가 확장됨에 따라 사용자와의 지역성은 점점 더 중요해지고 있습니다.

데이터 센터는 가능한 모든 곳에 배치하여 글로벌 트래픽을 처리할 수 있습니다. 이는 훈련 후 워크로드가 컴퓨팅에서 빠르게 증가하고 있다는 사실, 즉 지연 시간에 민감하지 않고 대규모 중앙 집중식 컴퓨팅을 필요로 하지 않는다는 사실에 더욱 기인합니다.

Depreciation Schedules and the Future of GPUs in Azure - Azure의 감가상각 일정 및 GPU의 미래

이러한 대체 가능한 자산들을 분석해 보면 중요한 고려 사항이 있습니다. 최근 많은 관심을 받고 있는 것이 바로 감가상각입니다.

악명 높은 마이클 버리는 최근 모든 하이퍼스케일러(메타, 구글, 오라클, Microsoft, 아마존)가 IT 자산의 유효 수명을 연장함으로써 인위적으로 수익을 늘리고 있다고 주장했습니다. 이러한 증가로 인해 "유효 수명"은 2020년 3 ~ 5년에서 현재 5~6년으로 늘어났습니다.

Burry 박사의 주장은 엔비디아 제품 주기가 현재 자산의 내용연수보다 훨씬 짧은 2~3년이라는 가정에 근거하고 있습니다. 저희는 이것이 주장의 치명적인 오류라고 생각합니다. 새로운 회계 처리 방식은 단기적으로는 기업에 유리하지만, 데이터센터의 실제 운영 경험을 바탕으로 하고 있습니다.

2020년, Microsoft, 메타, 구글이 내용연수를 3년에서 4년으로 늘렸을 당시는 아직 ChatGPT 출시 2년전 이었습니다. 현재, ChatGPT 출시 이후 3년인 오늘날, 내용연수 증가는 자본지출(CAPEX)에 목마른 하이퍼스케일러에게 유익한 것으로 입증되었습니다.

2020년부터 2025년까지 IT 장비 분야에서 어떤 변화가 시작되었을까요? 바로 신뢰성과 인센티브입니다.

Dell, SuperMicro, HPE, Lenovo, Cisco와 같은 서버 OEM은 오랫동안 3~5년의 표준 보증 기간이 있는 서버를 판매해 왔습니다. 5년 보증은 물론 더 비싸지만 6~7년의 연장 보증 옵션이 많이 있습니다. 물론 가격은 오르지만 공급업체가 마모된 노드에 대한 서비스 콜을 할 수 있을 만큼 충분한 예비 부품을 비축하기만 하면 됩니다.

한편, Cisco, Arista, Aruba, Juniper와 같은 네트워킹 장비 공급업체는 스위치에 대한 평생 보증을 시험해 보았습니다. 스토리지 공급업체도 동일한 것을 제공했습니다. 연간 지원 계약만 지불하면 마모된 드라이브를 계속 교체해 줍니다. 자동차를 생각해 보세요. 시장의 고급 고객은 2년마다 벤츠를 리스하고 업그레이드하는 반면, 다른 사람들은 휘발유와 보험료를 내고 20년 된 낡은 차를 몰고 다닙니다.

세계 최대 규모의 HPC 클러스터와 슈퍼컴퓨터를 살펴보면 이 점이 증명됩니다. 이러한 최첨단 시스템은 시중에서 가장 크고, 성능이 뛰어나고, 가장 뜨겁고(때로는 가장 효율적인) 프로세서를 구동합니다. 슈퍼컴퓨팅 센터는 액체 냉각 방식을 최초로 도입했으며, 데이터센터에 시스템을 설치하는 대신 시스템을 중심으로 데이터센터를 구축한 경험이 있습니다.

오크리지 국립연구소의 IBM Summit은 오랫동안 Top500에서 세계에서 가장 빠른 슈퍼컴퓨터였습니다. 2018년 6월에 생산을 시작했으며, 6.5년간의 연속 운영 후 2024년 11월에 폐기되었습니다. Summit은 2016년에 출시된 IBM Power9 프로세서를 사용했으며, 구매는 2014년에 완료되었습니다.

Fugaku는 2020년 일본 이화학연구소(RIKEN)에 설치되어 Top500에서 7위를 차지하며 현재까지 운영되고 있습니다. Sierra는 2018년 LLNL에 설치되어 20위를 차지하며 현재까지 운영되고 있습니다.

선웨이 타이후라이트(Sunway TaihuLight)는 2016년 중국 우시(Wuxi) 국가 슈퍼컴퓨팅센터에 설치되었습니다. 현재까지도 운영 중이며 21위를 차지하고 있습니다. 엘 캐피탄(El Capitan), 프론티어(Frontier), 오로라(Aurora)(각각 1위, 2위, 3위)와 같은 엑사스케일 시스템은 2021년부터 2025년까지 가동을 시작했으며, 2027년부터 2032년까지 가동될 것으로 예상됩니다.

마지막으로, Eagle - Microsoft NDv5는 14,400개의 H100을 탑재하여 2023년에 설치되었으며 5위를 차지했습니다. 이 시스템은 높은 활용도를 보이며 향후 수년간 운영될 것으로 예상됩니다.

현재 클라우드 공급업체를 살펴보면, AWS에서 8개의 V100 GPU를 탑재한 p3.16xlarge를 판매하고 있습니다. DataCrunch, Paperspace, Lambda Labs와 같은 기반 공급업체의 Shadeform, Prime Intellect, Runpod와 같은 마켓플레이스를 통해 유사한 인스턴스를 찾을 수 있습니다.

V100은 2017년 5월에 발표되었으며, 대량 출하가 2017년 가을에 시작되었고, NVIDIA의 최종 제품 출하가 2022년 1월에 이루어졌습니다. 즉, NVIDIA는 새로운 GPU 출시 이후 5년 이상 예비 부품을 공급했습니다. 하이퍼스케일러와 OEM은 예비 부품을 재고로 확보하고 V100 GPU가 출시된 지 무려 8년이 지난 현재까지 인스턴스를 계속 실행할 충분한 시간을 확보했습니다.

물론, 오늘날 V100은 순수한 MW당 수익 기준으로 보면 그리 좋은 사업이 아닙니다. 하이퍼스케일러들이 최신 고성능 GPU를 위한 공간을 확보하기 위해 기존 데이터센터에서 V100, A100, 심지어 구형 H100 GPU를 폐기하는 것을 볼 수 있을 정도입니다. 핵심은 GPU가 노후화되어 성능이 저하되기 때문이 아닙니다. 오히려 전력 및 공간 제약으로 인해 수익 창출 자산을 폐기하고 고수익 창출 자산을 확보하는 것입니다.역자주: 자원이 부족한 연구소나 단순 추론 서비스 하는 곳에서는 V100, A100 모두 아직까지 충분한 수요가 있습니다.

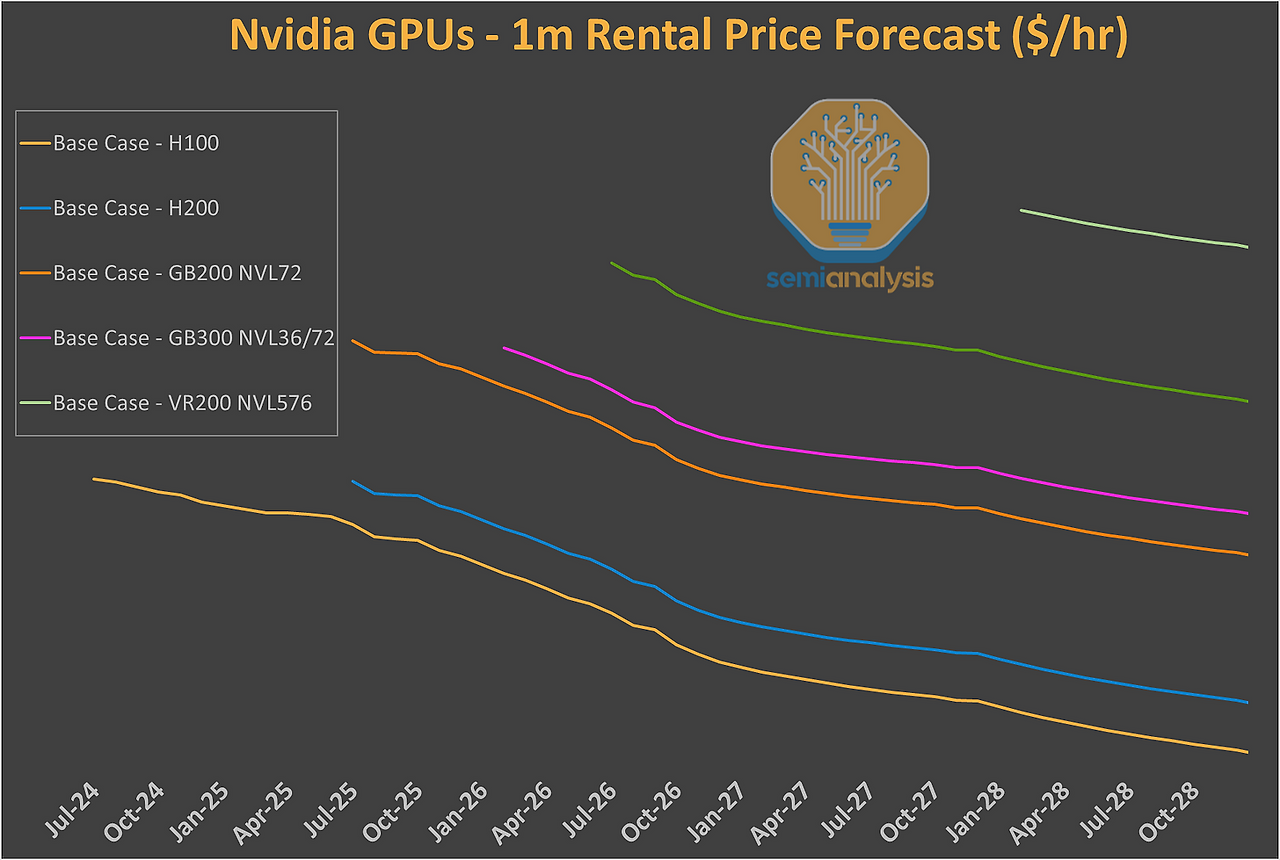

GPU 클라우드 경제성을 최적화하는 핵심은 경제 수명을 극대화하는 것입니다. H100 클러스터의 TCO를 분석한 결과, 자본 비용을 제외한 운영 비용은 GPU당 시간당 $0.30~$0.40입니다. 문제는 5년 후에도 GPU가 이 비율 이상으로 수익을 창출할 수 있을지 여부입니다.

운영 비용은 GPU당 창출되는 수익과 일치해야 합니다. 엔비디아가 달러당 처리량과 와트당 처리량을 크게 향상시키는 새로운 칩을 출시함에 따라 GPU 가격 결정력은 자연스럽게 빠르게 약화됩니다.

우리의 역사적 적중률은 놀라울 정도로 정확했습니다! 하지만 Azure와 같은 기업의 관점에서 보면, 목표는 전체 시장 대비 더 높은 가격 결정력을 확보하는 것입니다. 이는 아직 불확실하지만, 여러 가지 방식으로 나타날 수 있습니다.- Azure는 기업 관계, PaaS 계층, 그리고 수직적 통합(앱, 모델, 토큰 등)을 활용하여 6년 된 GPU에서 조기 폐기를 피할 만큼 충분한 가치를 창출할 수 있을 것입니다.

- 기업 비즈니스와 관련된 또 다른 방법은 가속 컴퓨팅과 함께 고마진 서비스(예: 데이터베이스와 같은 AI가 아닌 서비스)를 Up-Sell하는 것입니다. 6년 된 GPU가 단독으로는 수익을 창출하지 못하더라도, 고마진 서비스의 상향 판매를 유도하는 원인이 된다면, 계속 운영하는 것이 합리적일 수 있습니다.

저희는 이러한 이유로 Azure의 "대체 가능한 플릿(fungible fleet)" 전략이 타당하며 다른 업체보다 구조적으로 더 높은 ROIC를 달성할 수 있다고 생각합니다. 가장 큰 불확실성은 기업 도입 규모와 Azure가 고부가가치 서비스를 업셀링할 수 있을지 여부입니다.

미래는 어떻게 될까요? Vera Rubin이 성능 주장을 실현하고, Burry 박사의 주장처럼 단 2~3년 만에 하이퍼스케일러들이 수익성이 좋고 성능이 뛰어난 GPU를 폐기하도록 유도할까요? 아니면 H100 가격 데이터의 최저점이 앞으로도 유지될까요?

Azure Foundry: the Enterprise Token Factory (Azure Foundry: 엔터프라이즈 토큰 팩토리)

Azure Foundry는 Microsoft의 "서비스형 토큰(Token-as-a-Service)" 사업으로, M365 Copilot 및 Github Copilot과 같은 서비스에서 내부적으로 사용되는 모델(1P 토큰)과 추론 엔드포인트를 통해 모델을 사용하려는 외부 고객(3P 토큰) 모두에서 사용되는 다양한 모델을 제공합니다. Azure Foundry는 OpenAI API와 유사한 방식으로 시장에 출시되어 개인 및 기업 사용 사례에서 경쟁합니다. Azure는 OpenAI 모델 가중치에 대한 IP 권리를 보유하고 있기 때문에 독립적인 가격 결정도 가능합니다.

현재 대부분의 GPT API 토큰은 OpenAI를 통해 직접 처리되지만, Foundry는 향후 Microsoft의 주요 성장 동력이 되어 시장 점유율을 회복할 것으로 예상됩니다. Microsoft에게 중요한 점은 Azure가 OpenAI API 또는 Azure Foundry를 통해 제공되든 관계없이 2032년까지 모든 API 추론 컴퓨팅의 100% 점유율을 차지한다는 것입니다.

하지만 기업에 토큰을 판매하는 사업은 아직 초기 단계라고 생각합니다. 알파벳의 순다르 피차이는 2025년 3분기 실적 발표에서 당사의 입장을 확인하는 흥미로운 정보를 제공했습니다.

지난 12개월 동안 약 150개의 Google Cloud 고객이 다양한 애플리케이션에 대해 당사 모델을 사용하여 각각 약 1조 개의 토큰을 처리했습니다.

이러한 정보는 이 150개 기업에 대한 Gemini 토큰 판매가 GCP 사업의 0.5%에도 미치지 못한다는 것을 시사합니다.

토큰을 수익으로 전환하는 것은 생각보다 훨씬 복잡합니다. 분석가들이 입출력 비율, 캐시된 토큰을 고려하지 못하거나, 가격을 잘못 계산하는 등의 영역에서 큰 실수를 저지르는 것을 종종 볼 수 있습니다.

Application layer: GitHub Copilot’s Moat Under Siege (애플리케이션 계층: GitHub Copilot의 포위 공격에 직면)

코드 지원을 위한 애플리케이션 계층에서 Microsoft는 GitHub Copilot으로 완벽한 지배력을 누렸습니다. Microsoft는 현재 "탭" 모델이라고 흔히 불리는 최초의 인라인 코드 모델을 보유하고 있었으며, 독점적인 IP 접근 권한을 바탕으로 GPT-4를 Copilot과 조기에 통합했습니다.

멀리서 보기에 Microsoft의 요새는 난공불락처럼 보였습니다. 업계 표준 도구인 VS Code와 GitHub를 보유하고 있었고, 제품 개발을 위한 OpenAI 모델 IP에 대한 독점적인 접근 권한과 판매 가능한 막대한 기업 기반을 보유하고 있었습니다.

그러나 Microsoft는 모델과 코드베이스 간의 더욱 긴밀하고 향상된 통합을 구축하기 위해 VS Code를 포크하는 일련의 스타트업 (예를들어 Cursor) 이 등장한 것을 과소평가했습니다. 이러한 스타트업들은 Copilot을 넘어 공동으로 확장할 수 있었습니다. 이러한 성장을 가능하게 한 주요 요인은 스타트업들이 Anthropic의 모델을 사용했다는 것입니다.

Microsoft는 2025년 초, 마지못해 Anthropic을 Github Copilot에 추가했지만, 마진에 큰 비용을 지출했습니다. Github Copilot은 거의 1P 토큰을 제공하던 기존 방식에서 Anthropic으로부터 상당량의 토큰을 구매해야 했고, 이로 인해 50~60%의 총 마진이 발생했습니다.

연구소들은 자체적으로 제품 개발도 진행했습니다. 사용자는 하나의 모델 세트에 종속되지만, 이 모델들은 프로덕션 환경에서 사용되는 하네스와 환경에서 학습되었습니다. 이를 통해 Codex와 Claude Code의 매출 증가에서 알 수 있듯이 최적화된 경험이 제공되었고, 이는 매우 인기가 높습니다.

Microsoft는 이후 모델 슈퍼마켓 생태계 구축에 더욱 박차를 가하여, 최근 Google과 xAI를 포함한 다양한 연구소의 상담원과 연동되는 Agent HQ를 출시했습니다.

OpenAI 모델 가중치에 대한 접근 기간이 2032년까지만 연장됨에 따라, 이 회사는 현재 가장 높은 마진을 자랑하는 OpenAI 모델 제공에 대한 백업 플랜이 필요할 것입니다.

Microsoft’s homemade models: MAI (Microsoft의 자체 제작 모델: MAI)

Microsoft는 텍스트, 이미지, 음성에 걸쳐 3가지 MAI 모델을 출시했습니다. 텍스트 모델인 MAI-1은 현재 LMArena에서 약 38개 정도이지만, 채팅이나 API를 통해 공개적으로 사용할 수는 없습니다. 이 모델은 15,000대의 H100에서 학습된 대규모 MoE이며, 다음 모델은 훨씬 더 큰 규모의 다중 모달 LLM이 될 것입니다.

나머지 두 모델은 각각 이미지 모델과 음성 모델입니다. 이미지 모델은 여전히 LMArena에서 상위 10위권 모델이며, 두 모델 모두 Copilot에서 사용할 수 있습니다.

Microsoft에게 후자의 두 모델은 저렴하면서도 적절한 품질의 모델을 제공할 수 있는 사용 사례를 나타냅니다. 이 모델들이 최첨단 모델에 도전하기에는 아직 이르지만, Microsoft는 향후 몇 년 동안 연간 약 160억 달러에 달하는 컴퓨팅 비용을 지출하며 훨씬 더 큰 규모의 내부 학습에 조용히 투자할 준비를 하고 있다고 생각합니다.

Office 365 Copilot

Microsoft Copilot은 GitHub Copilot 외에도 다양한 기능을 아우르는 포괄적인 솔루션입니다. 영업, 재무, 서비스, 보안 등 다양한 기능을 위한 Copilot이 있습니다. 이 솔루션은 월간 활성 사용자 수 1억 명을 돌파했으며, 전반적인 AI 도입을 촉진하는 중요한 역할을 할 것입니다.

Office 365 Copilot을 구축하기 위한 최신 노력은 Office Agent에 포함되어 있으며, 아래에서 Excel 에이전트에 대해 자세히 살펴보겠습니다. 이러한 에이전트의 궁극적인 목표는 Microsoft 생태계 전반에서 사용자에게 자율적이고 기능적이며 유용한 방식으로 작업을 수행하는 것입니다.

https://spedtrder.tistory.com/69어시스턴트 에서 에이전트로: Microsoft Copilot의 전진과 옆길 (25.10.13)

From Assistants to Agents: Microsoft’s Copilot Steps Forward, and SidewaysMicrosoft 365 Premium과 새로운 Copilot "에이전트"에 대한 Microsoft의 최신 발표는 생산성 향상을 위한 AI의 미래를 향한 중요한 발걸음을 의미합

spedtrder.tistory.com

Microsoft’s edge: OpenAI IP and Office user data (Microsoft의 우위: OpenAI IP 및 Office 사용자 데이터)

OpenAI의 모델, 가중치 및 코드 베이스에 대한 접근을 통해 Microsoft는 OpenAI 모델의 원시 Chain of Thought에서 추출할 수 있습니다.

추출은 소규모 모델을 사후 학습하는 것보다 효과적이므로, Microsoft는 상당한 컴퓨팅 비용 없이 상당한 역량을 확보할 수 있습니다.

OpenAI IP에 대한 접근을 통해 Microsoft는 Office 제품군을 기반으로 하네스나 환경을 구축하는 기업이 외부에서 제공하는 것보다 더 세부적이거나 기본적인 데이터를 활용하여 OpenAI 모델을 미세 조정할 수 있습니다.

저희는 모든 제품에서 OpenAI 모델을 최대한 활용할 것입니다.

Excel Agent는 OpenAI 추론 모델 중 하나를 사후 학습한 버전입니다. Microsoft는 이를 통해 프론티어 랩보다 더 나은 결과를 얻었다고 주장합니다.

Azure의 AI 사업을 심층적으로 살펴본 후, 이제 Azure AI 하드웨어 스택의 두 가지 핵심 요소에 주목해 보겠습니다.- Microsoft의 실제 칩 전략: NVIDIA, Maia, OpenAI, AMD 등의 칩과 어떻게 균형을 맞출 것인가

- Azure의 네트워킹 아키텍처와 다양한 공급업체에 미치는 영향

Mama Ma-ia!: Custom ASIC Struggles (맘마-Maia!: 커스텀 ASIC의 난항)

맞춤형 실리콘 개발 분야에서 마이크로소프트는 하이퍼스케일러 중 최하위에 머물러 있으며, 따라잡으려는 노력조차 하지 않고 있습니다.

마이크로소프트는 2023년 말, 4대 하이퍼스케일러 중 AI 가속기 ASIC을 탑재한 최신 제품인 Maia 100 가속기를 선보였습니다.

https://newsletter.semianalysis.com/p/microsoft-infrastructure-ai-and-cpuMicrosoft Infrastructure - AI & CPU Custom Silicon Maia 100, Athena, Cobalt 100

Specifications, Volumes, GPT-4 performance, Next Generation Timing / Name, Backend Design Partner

newsletter.semianalysis.com

1세대 실리콘에서 예상했던 대로, Maia 100은 대량 생산되거나 프로덕션 워크로드에 사용되지 않았습니다. 이 칩은 Gen AI 붐 이전에 설계되어 추론에 적합한 메모리 대역폭이 부족했습니다. ASIC 프로그램은 상용 시스템에서 의미 있는 컴퓨팅 부하를 분산할 수 있을 때까지 여러 세대에 걸쳐 반복 작업을 반복해야 합니다.

원문:

https://newsletter.semianalysis.com/p/microsofts-ai-strategy-deconstructedMicrosoft's AI Strategy Deconstructed - from Energy to Tokens

"The Big Pause", AI Tokens Factory Economics Stack, OpenAI, Neocloud Renting, GitHub Copilot Woes, MAI and Maia Floundering

newsletter.semianalysis.com

반응형'TechStock&Review > AI&Cloud&SW' 카테고리의 다른 글

‘지구인 여러분, 안녕하세요’: 엔비디아의 지원을 받는 스타클라우드, 우주에서 첫 AI 모델 훈련 시작…궤도 데이터 센터 경쟁 시작 (25.12.15) (0) 2025.12.15 TPU 위협론: 시장의 소음(FUD)과 본질(Signal)의 분리 (25.12.8) (0) 2025.12.08 AWS Trainium: AI 군비 경쟁 속 아마존 맞춤형 실리콘 전략 심층 분석 (25.11.3) (1) 2025.11.03 어시스턴트 에서 에이전트로: Microsoft Copilot의 전진과 옆길 (25.10.13) (0) 2025.10.13 Microsoft 데이터 센터의 AI 칩 레밸 냉각기술 (25.9.25) (1) 2025.09.25