-

Gemini AI의 숨겨진 효율성, 구글은 어떻게 측정하고 개선했을까? (25.8.25)TechStock&Review/AI&Cloud&SW 2025. 8. 25. 08:29

AI 기술의 발전이 놀라운 속도로 이루어지면서 우리의 삶을 변화시키고 있지만, 그와 함께 인공지능이 환경에 미치는 영향에 대한 관심도 커지고 있습니다. 특히 AI 모델을 학습시키는 과정뿐만 아니라, 이미 학습된 AI 모델을 사용하여 예측하거나 텍스트, 이미지를 생성하는 '추론(inference)' 과정의 환경 발자국을 이해하는 것이 중요해졌습니다. 오늘은 구글이 어떻게 이 복잡한 문제를 측정하고 해결하기 위해 노력하고 있는지, 그들의 혁신적인 접근 방식에 대해 알아보겠습니다.

AI 추론의 환경 영향을 정확히 측정하는 구글의 포괄적인 방법론

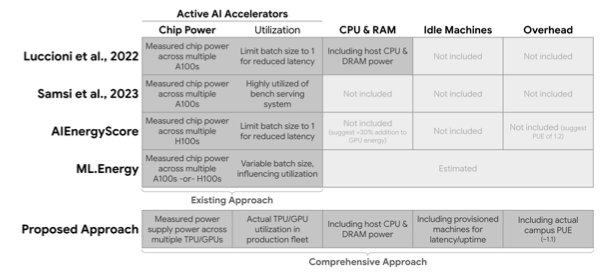

AI 추론의 에너지 및 환경 영향을 측정하는 것은 간단한 일이 아닙니다. 기존의 많은 AI 에너지 소비 계산은 주로 '활성 기계 소비'만을 포함하여 이론적인 효율성을 나타낼 뿐, 실제 운영 효율성을 과소평가하는 경향이 있었습니다. 이에 구글은 실제 대규모 AI 서비스 운영의 현실을 반영하는 '포괄적인(Comprehensive)' 방법론을 개발했습니다.

이 방법론은 다음과 같은 핵심 요소를 포함하여 AI의 전체 환경 발자국을 측정합니다.- 전체 시스템 동적 전력 (Full system dynamic power): AI 모델이 활발하게 계산을 수행할 때 사용되는 에너지뿐만 아니라, 실제 운영 규모에서 달성되는 칩 활용도까지 포함합니다. 이는 이론적인 최대치보다 훨씬 낮을 수 있습니다.

- 유휴 상태 머신 (Idle machines): 높은 가용성과 신뢰성을 보장하기 위해, 트래픽 급증이나 장애 조치를 처리할 준비가 되어 있지만 현재 유휴 상태인 예비 용량도 에너지 소비에 포함됩니다.

- CPU 및 RAM: AI 모델 실행은 TPU나 GPU 같은 ML 가속기에서만 이루어지는 것이 아닙니다. 호스트 CPU와 RAM도 AI 서비스에 중요한 역할을 하며 에너지를 소비합니다.

- 데이터센터 오버헤드 (Data center overhead): AI 워크로드를 실행하는 IT 장비가 소비하는 에너지 외에도, 냉각 시스템, 전력 분배 및 기타 데이터센터 인프라(PUE로 측정되는)도 에너지를 소비합니다.

- 데이터센터 물 소비 (Data center water consumption): 에너지 소비 및 관련 배출량을 줄이기 위해 데이터센터는 종종 냉각을 위해 물을 사용합니다. AI 시스템이 에너지 효율적으로 최적화될수록 물 소비량도 자연스럽게 감소합니다.

그림1: AI 추론 에너지 측정의 기존 및 제안된 경계. 기존 접근 방식은 주로 활성 AI 가속기의 에너지 소비량을 고려합니다. 여기서는 서빙 스택의 모든 구성 요소에서 측정된 에너지를 포함하여 AI 추론 에너지 소비량을 더욱 포괄적으로 측정하고, 이를 통해 서빙 스택 전반의 에너지 절감 방안을 제시할 것을 제안합니다.

반면, 기존의 비포괄적인 방법론은 주로 활성 TPU 및 GPU 소비만을 고려하며, 이는 실제 운영 발자국을 상당히 과소평가하는 경향이 있습니다. 구글은 이러한 포괄적인 측정 방식이 AI의 전반적인 발자국에 대한 가장 완전한 시각을 제공한다고 믿고 있습니다. 이 방법론은 다른 AI 모델, 하드웨어 및 에너지를 비교하고 시스템 전반의 효율성 최적화를 가능하게 합니다.Gemini Apps 텍스트 프롬프트의 환경 발자국: 놀라운 효율성

구글의 포괄적인 방법론을 적용한 결과, 2025년 5월 기준 Gemini Apps 텍스트 프롬프트 한 번의 중앙값 환경 발자국은 다음과 같이 추정되었습니다:

- 에너지: 0.24와트시(Wh). 이는 TV를 9초 미만으로 시청하는 것과 같은 양의 에너지입니다.

- 탄소 배출량: 0.03그램의 이산화탄소 환산량(gCO2e).

- 물 소비량: 0.26밀리리터(mL). 이는 약 다섯 방울의 물과 같습니다.

이 수치는 기존의 많은 공개 추정치보다 상당히 낮은 수준입니다. 이는 구글이 실제 프로덕션 환경에서 인프라를 직접 측정하고, 효율적인 대규모 배치 처리를 통해 달성한 결과로 해석됩니다. 예를 들어, 활성 AI 가속기 전력(0.14Wh)이 가장 큰 비중을 차지하지만, CPU 및 RAM(0.06Wh), 유휴 머신(0.02Wh), 데이터센터 오버헤드(0.02Wh)도 전체 에너지 소비에 기여합니다.

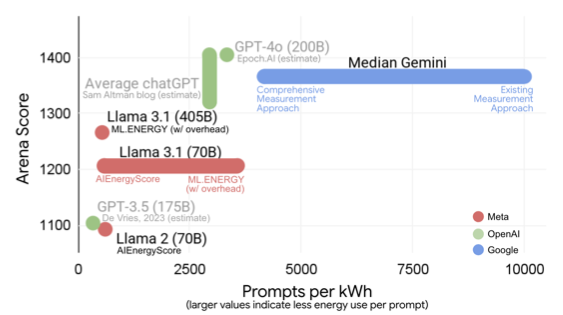

그림 2: LMArena 점수 대비 대규모 AI 모델의 프롬프트당 에너지 결과 - 추정 지표(회색 텍스트) 및 측정 지표(검정색, 빨간색, 파란색 텍스트). 유사한 모델과 매개변수 수의 경우, 측정 방식이 다르면 결과에 큰 차이가 발생할 수 있습니다. 예를 들어, Llama 3.1(70B)은 kWh당 프롬프트 수가 약 580개에서 약 3,600개로 다양합니다.

본 논문에 제시된 Gemini Apps 텍스트 프롬프트의 중간값 결과는 보다 좁게 정의된 기존 접근 방식(kWh당 프롬프트 10,000개) 부터 보다 완전한 종합 접근 방식(kWh당 프롬프트 4,167개)까지 다양한 결과를 보여줍니다.

그래프 상으로 Gemini 모델이 소비전력(kWh) 대비 많은 프롬프트 출력과 GPT-4o 와 유사한 모델 성능을 보여주고 있습니다.

그림3: 프로덕션 LLM 서빙 스택 전체의 프롬프트당 총 LLM 에너지 소비량 구성 요소. 에너지 구성 요소의 상대적 크기는 종합 측정 방식을 사용하여 2025년 5월 Gemini Apps 텍스트 프롬프트의 중간값을 기준으로 합니다. 지속적인 혁신으로 달성한 드라마틱한 효율성 향상

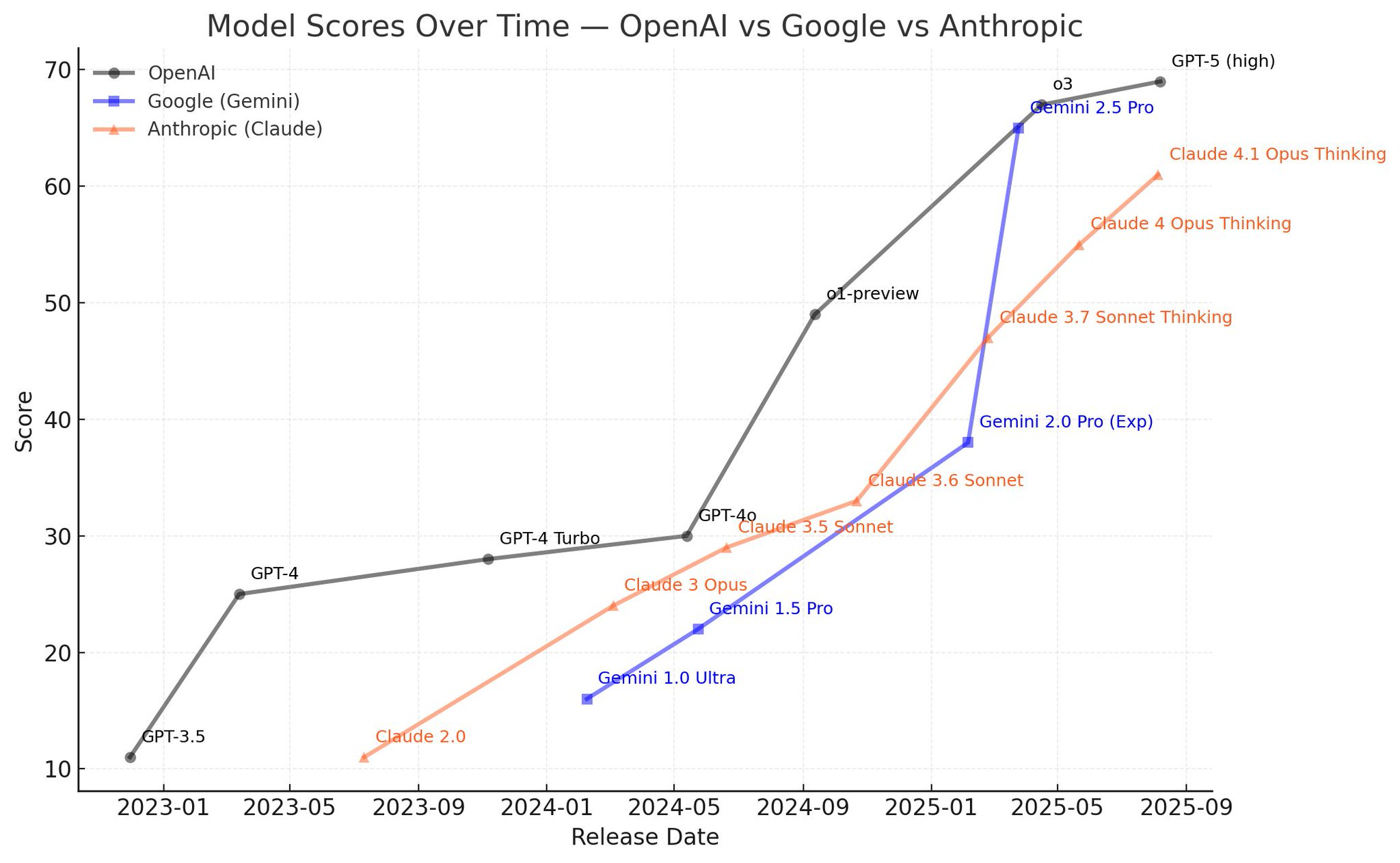

구글은 AI 시스템이 지속적인 연구 혁신, 소프트웨어 및 하드웨어 효율성 개선을 통해 더욱 효율적으로 변모하고 있다고 강조합니다. 최근 12개월 (24년 5월 대비 25년 5월) 동안, Gemini Apps 텍스트 프롬프트의 중앙값 에너지 발자국은 33배 감소했으며, 총 탄소 발자국은 44배 감소했습니다. 이는 더 높은 품질의 응답을 제공하면서 달성된 결과입니다.

그림4: 시간 경과에 따른 Gemini 앱 텍스트 프롬프트 배출량 중간값

이러한 극적인 효율성 향상은 구글의 '풀 스택(full-stack)' AI 개발 접근 방식 덕분입니다. 다음은 주요 혁신 분야입니다:- 더 효율적인 모델 아키텍처 (More efficient model architectures): 구글 연구원들이 개발한 Transformer 모델 아키텍처를 기반으로 하며, 이전 아키텍처 대비 10~100배의 효율성 향상을 제공합니다. Mixture-of-Experts (MoE) 같은 구조는 쿼리에 필요한 작은 모델 부분만 활성화하여 계산 및 데이터 전송을 10~100배 줄입니다.

- 효율적인 알고리즘 및 양자화 (Efficient algorithms and quantization): Accurate Quantized Training (AQT)와 같은 방법을 통해 응답 품질을 저하시키지 않으면서 효율성을 극대화하고 에너지 소비를 줄입니다.

- 최적화된 추론 및 서비스 (Optimized inference and serving): Speculative Decoding과 같은 기술은 더 적은 칩으로 더 많은 응답을 제공하며, 증류(distillation) 기술은 더 작은 서비스 최적화 모델(Gemini Flash 및 Flash-Lite)을 만듭니다.

- 맞춤형 하드웨어 (Custom-built hardware): 10년 이상 TPU를 설계하여 와트당 성능을 극대화하고 있습니다. 최신 세대 TPU인 Ironwood는 첫 번째 공개 TPU보다 30배 더 에너지 효율적입니다.

- 최적화된 유휴 (Optimized idling): 수요에 따라 모델을 실시간으로 동적으로 이동시켜 CPU 활용도를 높이고 TPU 유휴 시간을 최소화합니다.

- ML 소프트웨어 스택 (ML software stack): XLA ML 컴파일러, Pallas 커널 및 Pathways 시스템은 JAX와 같은 상위 시스템에서 표현된 모델 계산이 TPU 서비스 하드웨어에서 효율적으로 실행되도록 합니다.

- 초고효율 데이터센터 (Ultra-efficient data centers): 구글의 데이터센터는 업계에서 가장 효율적이며, 전체 평균 PUE는 1.09입니다. 또한, 물 고갈 위험이 높은 지역에서는 공기 냉각 기술을 사용하여 물 사용량을 제한하고 있습니다.

- 책임감 있는 데이터센터 운영 및 청정 에너지 조달 (Responsible data center operations / Clean energy procurement): 구글은 24/7 무탄소 에너지 목표를 추구하며 청정 에너지 발전을 지속적으로 추가하고 있습니다. 2023년부터 2024년까지 전력 소비가 증가했음에도 불구하고, Scope 2 MB 배출량은 감소하여 전력 소비와 배출량 영향 간의 중요한 분리(decoupling)를 보여줍니다.

24년 5월은 Gemini 1.5 Pro 모델, 25년 5월은 Gemini 2.5 Pro, Gemini 2.5 Flash 가 출시된 시점으로 성능 뿐만 아니라 에너지 비용과 관리 비용 측면에서 괄목할만한 개선이 이루어진것을 알 수 있다.

결론: 책임감 있는 AI 개발을 향한 길

AI 수요가 계속 증가함에 따라, 프롬프트당 필요한 전력 소비량과 물 사용량을 줄이는 데 집중적인 투자가 이루어지고 있습니다. 구글은 이러한 측정 결과와 방법론을 공유함으로써 업계 전반의 AI 효율성 향상을 이끌어내고자 합니다.

하나의 AI 프롬프트가 환경에 미치는 영향은 다른 일상 활동에 비해 낮지만, 전 세계 사용자 채택의 엄청난 규모를 고려할 때 AI의 환경 비용을 줄이는 데 지속적으로 집중하는 것은 필수적입니다. 투명하고 포괄적인 측정 프레임워크를 널리 채택하여 AI의 역량이 발전하는 동시에 환경 효율성도 함께 발전할 수 있기를 기대합니다.

원문 및 Wokring Cite

Measuring the environmental impact of AI inference | Google Cloud Blog

A methodology for measuring the energy, emissions, and water impact of Gemini prompts shines a light on the environmental impact of AI inference.

cloud.google.com

반응형'TechStock&Review > AI&Cloud&SW' 카테고리의 다른 글

테슬라 AI 칩 세대 별 성능 비교 (25.9.17) (3) 2025.09.17 Oracle 이 AI 컴퓨팅 시장에서 승리하는 방법 (25.8.27) (7) 2025.08.27 H100 vs GB200 NVL72 학습 벤치마크 – 전력, TCO 및 신뢰성 분석, 시간 경과에 따른 소프트웨어 개선 (25.8.22) (6) 2025.08.22 CUTLASS CuTe 라이브러리와 메모리 주소 Layout (25.8.11) (6) 2025.08.11 GPT-5 출시 와 논란 (25.8.10) (10) 2025.08.10