-

Meta Superintelligence (25.7.18)TechStock&Review/AI&Cloud&SW 2025. 7. 18. 08:58

Meta Superintelligence – Leadership Compute, Talent, and Data

메타(Meta)가 약 300억 달러의 기업 가치를 지닌 Scale AI의 49%를 충격적으로 인수한 것은 연간 1,000억 달러 규모의 현금 흐름을 자랑하는 이 광고 기계에 돈은 전혀 중요하지 않음을 보여줍니다. 무한한 자원이 있는 것처럼 보이지만, 메타는 모델 성능 면에서 기초 연구실에 뒤처져 왔습니다.

메타가 오픈웨이트 모델 부문에서 딥시크(DeepSeek)에 선두 자리를 내주었을 때, 진정한 경종이 울려 퍼졌습니다. 이는 잠자던 거대 기업을 흔들었습니다. 이제 완전한 창업자 모드로 전환한 마크 저커버그는 메타를 직접 이끌며 메타의 두 가지 핵심 단점, 즉 재능과 컴퓨팅을 지적하고 있습니다. 기술 대기업을 운영하는 마지막 창업자 중 한 명인 마크는 미래에 자금을 지원하기 위해 자사주 매입을 늦추라는 SemiAnalysis의 조언이 필요 없을 정도입니다!

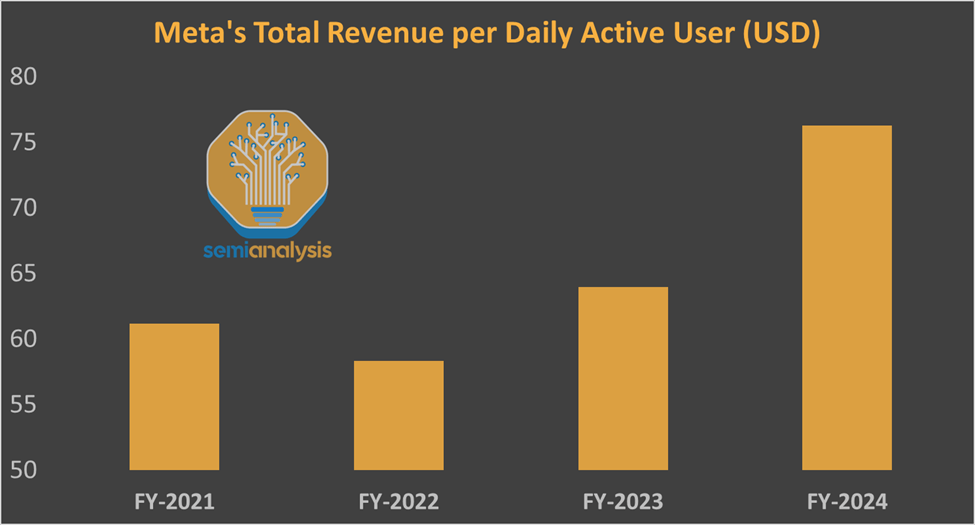

출처: Meta financials and SemiAnalysis estimates

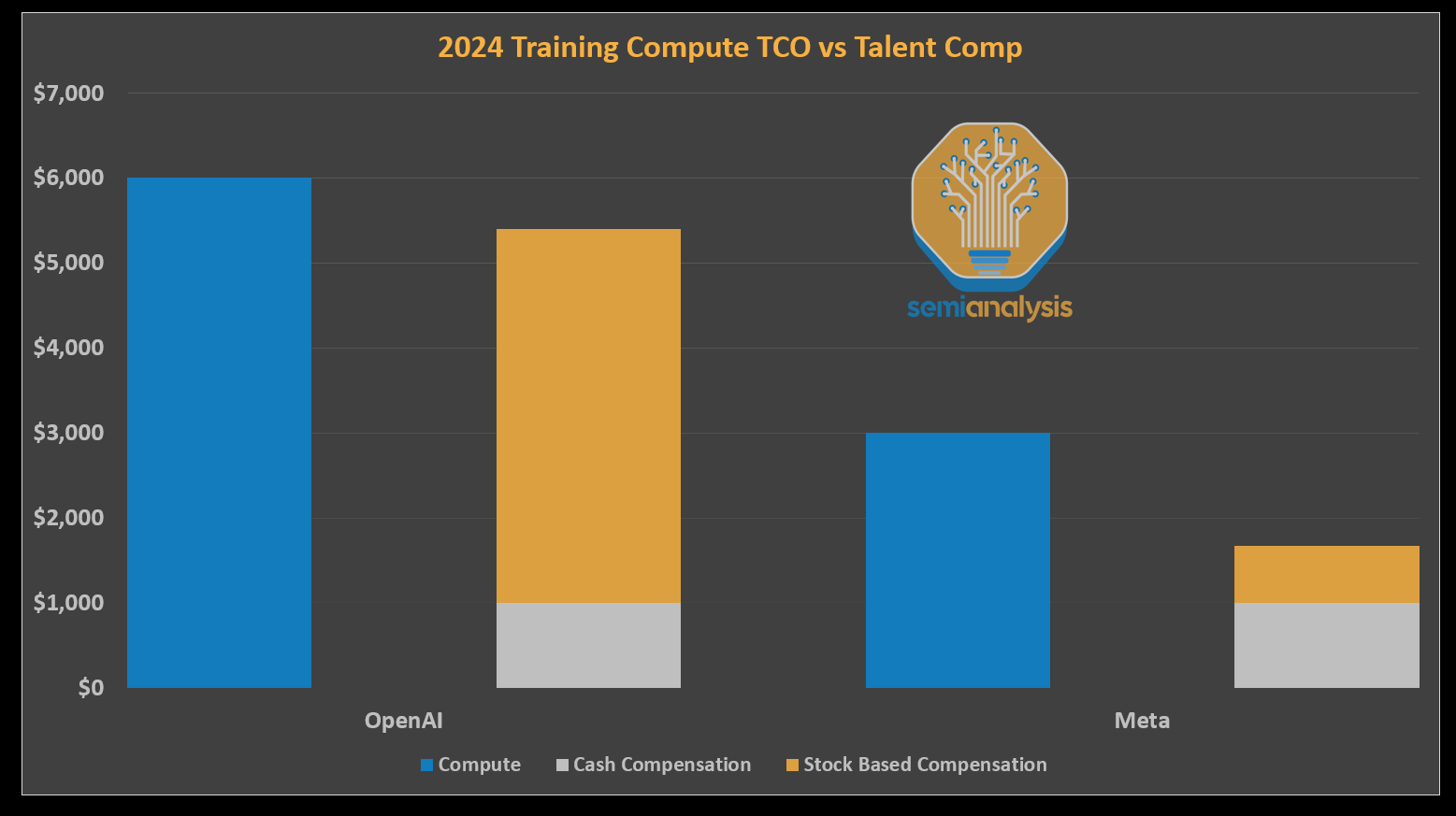

그는 문제 해결에 돈을 쏟아붓는 것 외에도, 메타의 GenAI 접근 방식을 근본적으로 재고하고 있습니다. 그는 새로운 "초지능" 팀을 처음부터 구성하고, 최고 운동선수의 연봉을 푼돈으로 여기게 하는 연봉으로 최고의 AI 인재들을 직접 영입하고 있습니다. 이 팀에 영입되는 사람들에게 제시되는 일반적인 연봉은 4년간 2억 달러입니다. 이는 다른 경쟁사들의 100배에 달하는 금액입니다. 게다가, OpenAI의 연구원/엔지니어링 경영진이 받아들이지 않은 수십억 달러 규모의 제안도 있었습니다. 이러한 제안들이 모두 성공적인 것은 아니지만, 저커버그는는 경쟁사들의 직원 1인당 비용을 대폭 인상함으로써 경쟁사들을 압도하고 있습니다.

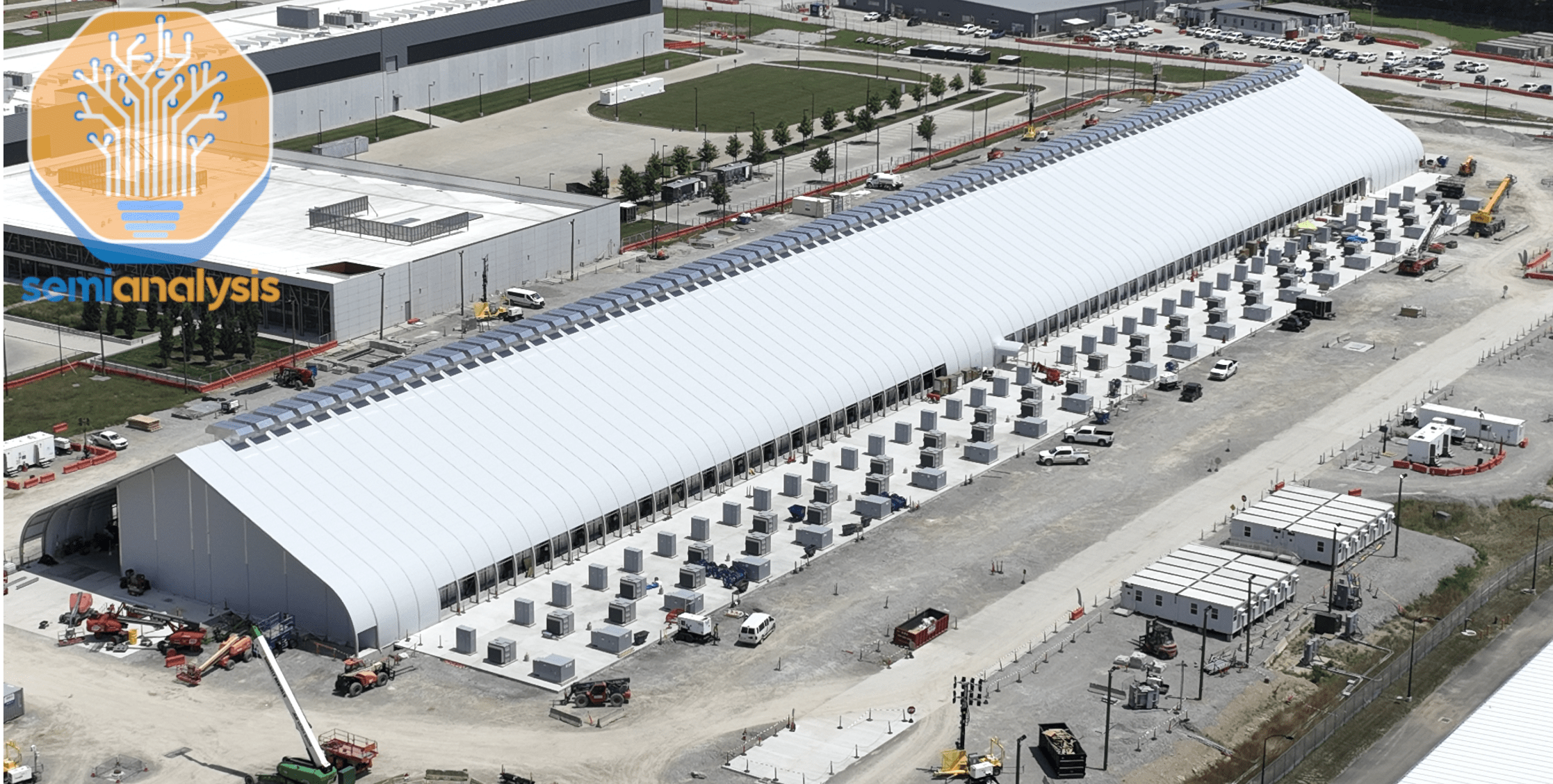

아마도 더욱 상징적인 점은 저커버그 자신의 데이터센터 플레이북 전체를 쓰레기통에 버리고 지금은 "텐트" (Tents)에서 수십억 달러 규모의 GPU 클러스터를 구축하고 있다는 것입니다!

출처: SemiAnalysis Datacenter Model – as of 07/06/2025

이 보고서에서 자세히 설명하듯, 모든 가능성을 열어두고 있습니다. 초지능을 추구하며 계산 능력에서 재능으로 변모한 메타의 전례 없는 혁신과 그 과정, 그리고 그 과정에 대한 이야기를 함께 살펴봅니다. Llama3.0 오픈소스 지배 (Dominance)에서 Llama4 베히모스의 대실패까지, 이 AI 거인은 몰락했지만 완전히 사라진 것은 아닙니다. 실제로 메타의 플롭스 학습 속도는 OpenAI에 버금갈 것으로 예상됩니다. Meta는 연구원 한 명당 GPU 부족에서 GPU 자원 부유 상태로 빠르게 전환되고 있습니다.

출처: SemiAnalysis Datacenter Model, SemiAnalysis Accelerate Model Meta GenAI 1.0: AI Incrementalism - AI 점진주의

OpenAI와 같은 순수 AI 연구실과 달리, Meta와 Google 같은 기업들은 기존 제품을 개선하여 더 나은 추천 시스템과 GenAI를 통해 광고 타겟팅, 콘텐츠 태그 지정, 내부 도구를 개선하는 "AI 점진주의" 전략을 추구해 왔습니다. 이러한 전략은 재무적 성과 측면에서 상당한 성과를 거두었으며, Meta는 iOS 14.5(2021년 말, 2022년 초)에 앱 추적 투명성(ATT) 기능을 출시하여 사용자 추적을 차단하려는 Apple의 시도를 무시할 수 있었습니다.

출처: Company filings

Meta가 Google보다 GenAI 혁신의 영향을 덜 받는다고 할 수 있지만, 두 회사의 LLM(데이터 과학) 연구는 다소 실망스러웠습니다. 그 이유 중 하나는 초지능 추구보다는 핵심 사업에 자본을 집중적으로 투자했기 때문입니다."올해 당사의 CapEx 성장은 생성적 AI와 핵심 사업 요구 사항에 모두 사용되고 있으며, 전체 CapEx의 대부분은 핵심 사업을 지원합니다 ." 출처: Meta 2025년 1분기 실적 발표, SemiAnalysis 강조

GenAI는 이러한 기술 대기업들의 사업을 확장하는 역할을 합니다. 챗봇 분야의 OpenAI나 API 코딩 분야의 Anthropic처럼 새로운 활용 사례를 주도해야 할 실존적 욕구는 그들에게는 없습니다. 이는 OpenAI와 같은 선도적인 AI 재단 연구소의 컴퓨팅 자원과 인적 자원 배분에서 Meta와 비교했을 때 명백하게 드러납니다. 저커버그의 영향력이 경쟁 제안과 급여 인상에 미치는 영향은 심각한 타격을 줄 것입니다.

출처: The Information, SemiAnalysis 추정

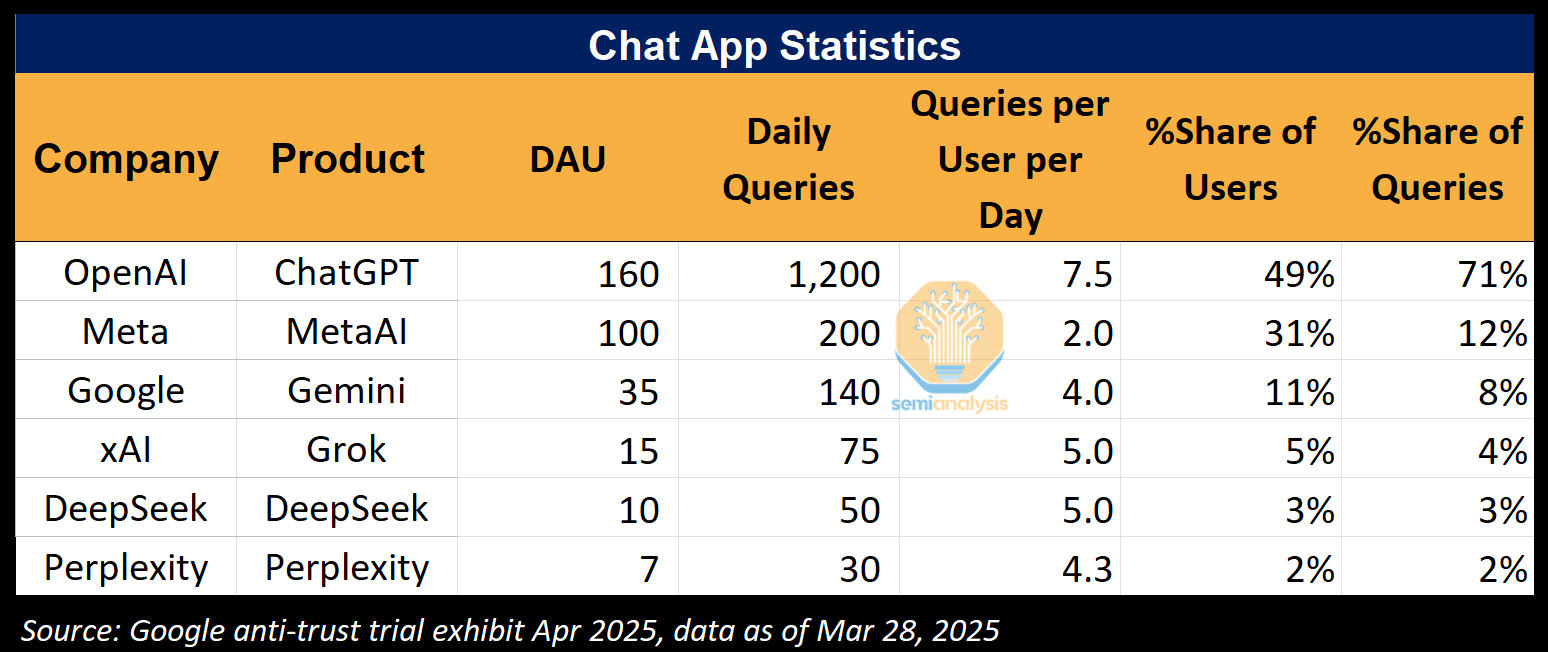

그 결과, GenAI 소비자 앱 트래픽을 측정할 때 Meta와 Google은 도달 범위와 참여도 측면에서 ChatGPT보다 유의미하게 뒤처졌습니다.

하지만 상황이 바뀌고 있습니다. 당사의 독점적인 Accelerator Industry Model 과 Datacenter Industry Model을 활용하여 향후 몇 년 안에 Meta의 GenAI 투자가 의미 있는 수준으로 증가할 것으로 예상합니다.

출처: SemiAnalysis Core Research Meta GenAI 2.0 – Part 1, Re-Inventing the Datacenter Strategy (Again) - 데이터센터 전략 재창조

From Buildings to Tents - 빌딩에서 텐트까지

불과 1년 전, Meta는 10년 된 "H"자형 데이터센터 청사진을 폐기하고 새로운 AI 최적화 설계를 도입했습니다.

출처: SemiAnalysis Datacenter Model

2025년, 저커버그는 전략을 다시 한번 혁신하기로 결정했습니다. xAI의 전례 없는 출시 기간 단축에 영감을 받아 Meta는 속도를 최우선으로 하는 데이터센터 설계를 채택하고 있습니다. 이미 더 많은 데이터센터를 구축하고 있습니다! xAI의 멤피스 부지와 출시 기간에 여전히 어려움을 겪고 있는 기존 데이터센터 및 부동산 투자자들은 또 한 번 충격을 받을 것입니다.

출처: SemiAnalysis Datacenter Model – 2025년 7월 6일 기준

이 디자인은 아름다움이나 중복성을 위한 것이 아닙니다. 컴퓨팅을 빠르게 온라인으로 전환하는 데 중점을 두고 있습니다! 조립식 전력 및 냉각 모듈부터 초경량 구조물까지, 백업 발전(즉, 디젤 발전기가 보이지 않음)이 없으므로 속도가 핵심입니다.

Power는 현재 인근 Meta의 현장 변전소를 사용하고 있습니다. Meta는 정교한 작업 부하 관리 시스템을 사용하여 전력망에서 공급받는 모든 전력의 활용도를 극대화할 것으로 예상됩니다. 심지어 가장 더운 여름철에는 작업 부하를 중단해야 할 수도 있습니다.

출처: SemiAnalysis Datacenter Model – 2025년 7월 1일 기준 The Prometheus 1GW AI Training Cluster – An “All Of The Above” Infrastructure Strategy

Meta는 오하이오에 세계 최대 규모의 AI Training 클러스터 중 하나를 조용히 건설하고 있습니다. Meta의 인프라 조직 내부 관계자로부터 이 클러스터를 프로메테우스(Prometheus)라고 부른다는 소식을 들었습니다. 경쟁 AI 연구소들을 따돌리기 위해 Meta는 "모든 것을 아우르는" 인프라 전략을 실행했습니다.

- 캠퍼스를 직접 건설합니다.

- 제3자로부터 임대.

- AI에 최적화된 디자인.

- 다중 데이터 센터 캠퍼스 Training .

- 현장에서 미터기 뒤에 설치한 천연가스 생산.

아래의 Prometheus Training 클러스터를 살펴보면, Meta가 모든 사이트를 Arista 7808 스위치와 Broadcom Jericho 및 Ramon ASIC으로 구동되는 하나의 백엔드 네트워크에서 초고대역폭 네트워크로 연결하고 있다고 생각됩니다.

출처: SemiAnalysis Datacenter Model

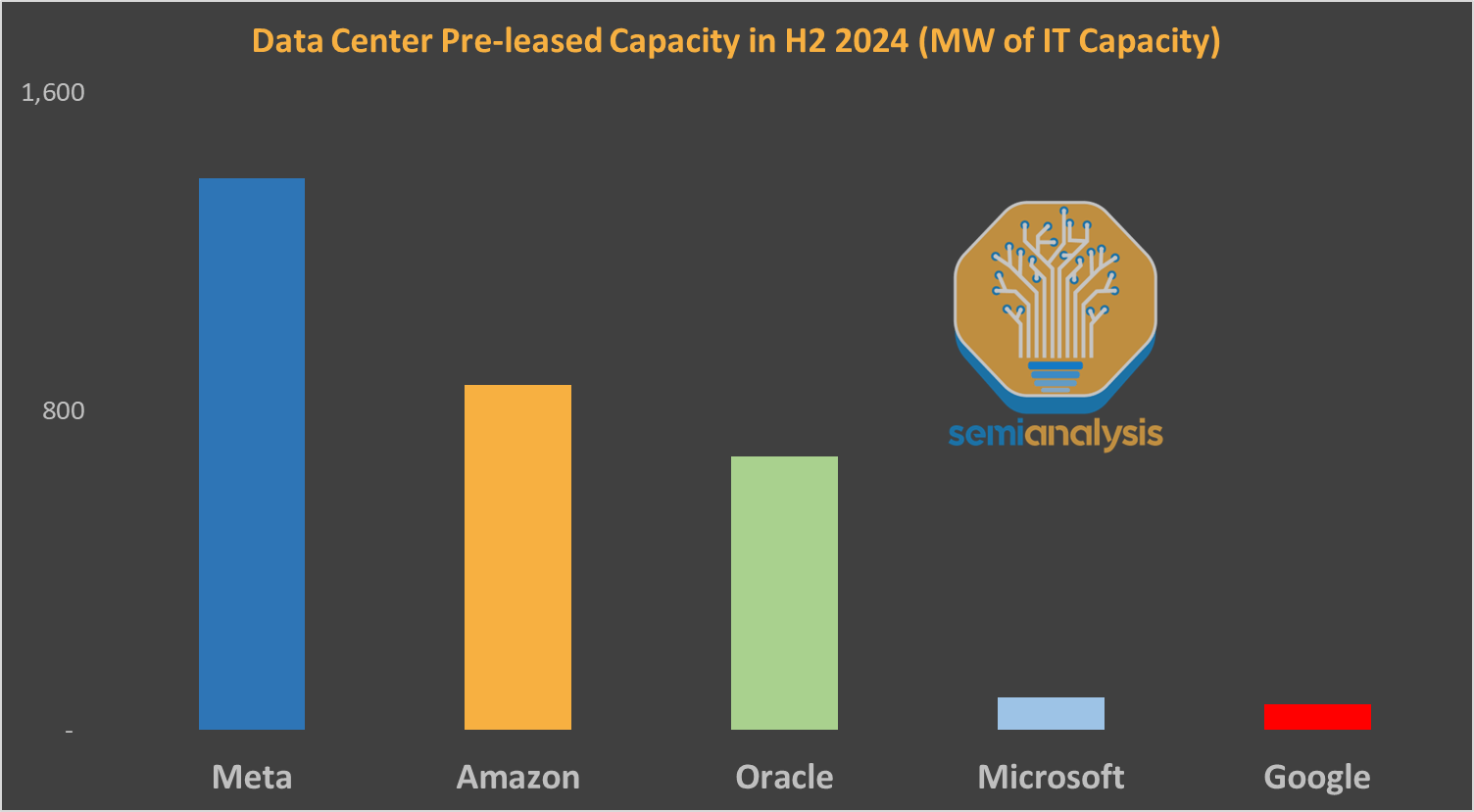

메타는 자체 구축과 임대를 결합함으로써 더욱 빠르게 성장하고 있습니다. 실제로 메타는 2024년 하반기에 오하이오를 중심으로 다른 하이퍼스케일러보다 더 많은 용량을 사전 임대했습니다.

출처: SemiAnalysis Datacenter Model

더욱이 지역 전력망이 감당할 수 없게 되자, Meta는 Elon 모드로 전환했습니다. 윌리엄스의 도움을 받아 200MW 규모의 천연가스 발전소 두 곳을 건설하고 있습니다. 첫 번째 발전소의 장비 내역은 다음과 같습니다.- 3 x Solar Turbines의 Titan 250 터빈

- 9 x PGM 130 터빈

- 3 x Siemens Energy SGT400 터빈

- 15 x CAT 3520 왕복 엔진

출처: Siemens Energy

향후 SemiAnalysis 보고서는 데이터 센터에 전력을 공급하는 이러한 시스템을 비용, 장단점 등 훨씬 더 심층적으로 분석할 것입니다. 이는 특정 현장 천연가스 솔루션 공급업체에 상당한 부정적 영향을 미칠 것입니다.

OpenAI의 이러한 총체적 컴퓨팅 이점은 강화 학습의 출현으로 인해 미국 전역에 분산된 많은 대규모 데이터 센터를 비동기적으로 사용하여 사후 학습을 통해 모델 지능을 개선하는 데 기여할 수 있다는 점에서 중요합니다 .

OpenAI에 뒤처지지 않기 위해, Meta의 두 번째 프런티어 클러스터인 Hyperion은 OpenAI와의 격차를 없애는 것을 목표로 합니다.

출처: SemiAnalysis 데이터센터 모델 및 가속기 모델 Beating Stargate at Scale: Meta’s Hyperion 2GW Cluster - 대규모 스타게이트 격파: 메타의 하이페리온 2GW 클러스터

모든 이목이 애빌린에 있는 유명 스타게이트 데이터센터에 쏠려 있는 가운데, 메타는 1년 넘게 대응 계획을 세워왔고 엄청난 진전을 이루고 있습니다. 루이지애나 클러스터는 2027년 말까지 세계 최대 규모의 개별 캠퍼스가 될 예정이며, 1단계에서는 1.5GW 이상의 IT 전력을 공급할 예정입니다. 소식통에 따르면 이 데이터센터의 내부 명칭은 하이페리온(Hyperion)입니다.

출처: DatacenterDynamics

메타는 2024년 말에 기공식을 가졌으며, 현재 전력 인프라와 데이터센터 캠퍼스 모두에서 활발하게 작업을 진행하고 있습니다.

출처: SemiAnalysis Datacenter Model – 2025년 7월 1 일 사진

Meta에는 현재 건설 중이거나 용량을 늘리고 있는 다른 데이터센터가 많이 있습니다. Meta의 AI 데이터센터 전체 목록, 예상 완공일, 그리고 분기별 건물당 전력 사용량은 데이터센터 산업 모델 에서 확인하실 수 있습니다.Llama 4 Failure – From Open-Source Prince to Behemoth Pauper (Llama 4 실패 - 오픈소스 왕자에서 Behemoth 빈민으로)

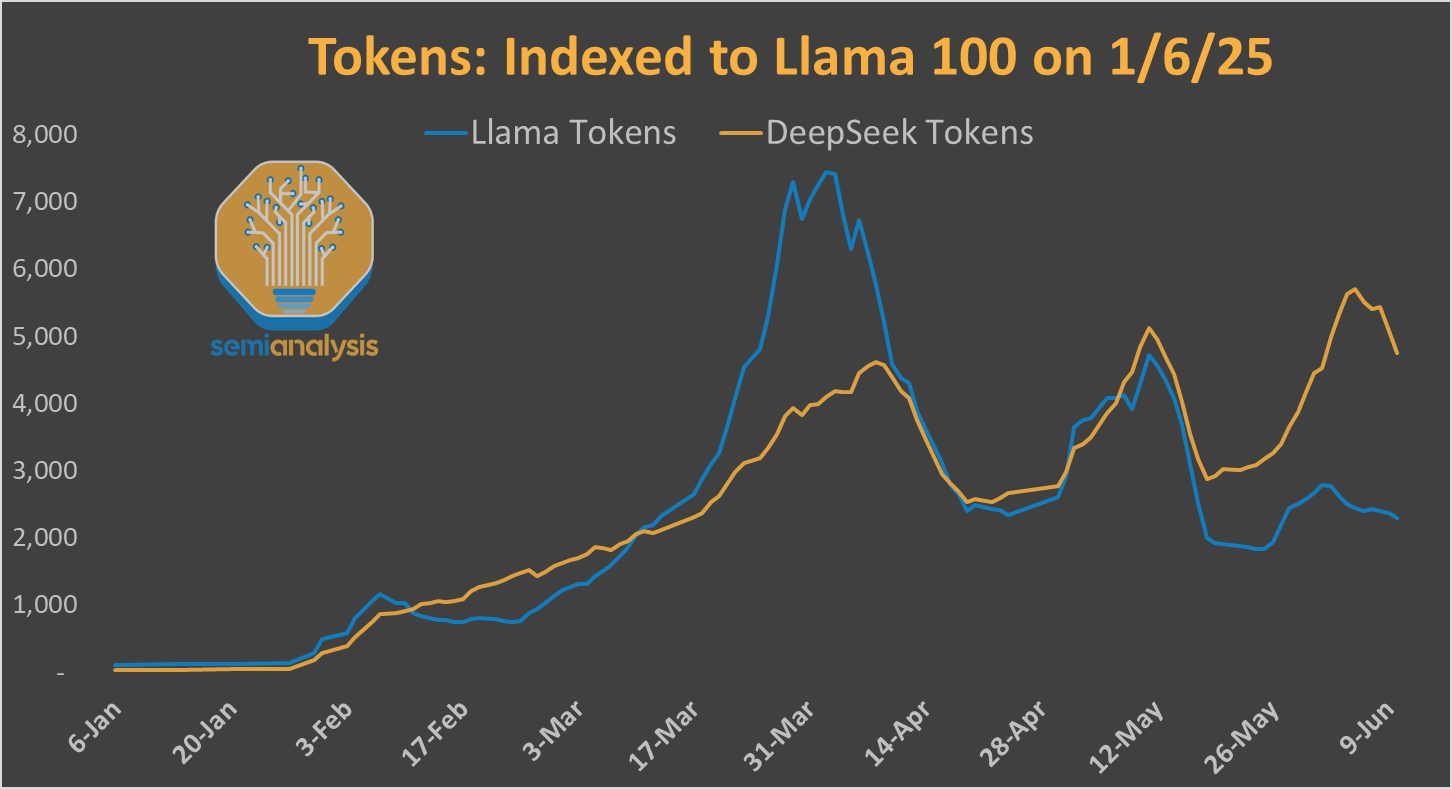

초지능 인재 경쟁에 뛰어들기 전에, Meta가 어떻게 이런 난처한 상황에 처하게 되었는지 살펴보겠습니다. Llama3 로 오픈소스의 최전선을 이끌었던 메타는 이제 중국의 딥시크(DeepSeek)에 뒤처지고 있습니다.

출처: OpenRouter, SemiAnalysis 추정

기술적인 측면에서 우리는 이번 실패의 주요 원인은 다음과 같다고 생각합니다.- Chunked attention

- Expert choice routing

- Pretraining data quality

- Scaling strategy and coordination

Chunked Attention

단순하게 구현된 대규모 언어 모델에서 어텐션은 토큰 개수에 따라 quadratically 으로 증가합니다. 이를 해결하기 위해 연구진은 메모리 효율적인 메커니즘을 도입했습니다. Meta는 Behemoth에 Chunked Attention을 선택했는데, 이는 실수였을 수 있습니다.

📌 참고:

✅ 1. 배경: Chunked Attention 왜 필요한가?

Transformer의 Self-Attention은 시간복잡도와 메모리 사용량이 시퀀스 길이 $n$에 대해 $O(n^2)$이기 때문에, 긴 시퀀스를 다룰 때 속도 저하와 메모리 부족 문제가 발생합니다.

✅ 2. Chunked Attention 개념

시퀀스를 작은 크기의 청크(chunk) 로 나눕니다. 예: 1024 token → 128 token × 8 chunk

각 chunk 내에서만 Attention을 계산하거나, 일부 인접 chunk끼리 Attention을 계산합니다.

✅ 3. 장점

💾 메모리 사용 감소: Full attention보다 훨씬 적은 메모리 사용

⚡ 속도 향상: 병렬 계산과 chunk 단위 처리로 연산 속도 개선

📏 긴 입력 처리 가능: Long sequence 학습이 가능해짐

출처: Awnihannun, SemiAnalysis

Standard Causal Attention : 왼쪽 상단 모서리에서 부채꼴 모양으로 퍼져 나가는 일련의 삼각형을 상상해 보세요. 이는 이후 각 토큰에 대한 attention 크기를 나타냅니다. 토큰을 두 배로 늘리면 삼각형의 면적은 4 배가 됩니다.

📌 참고:

🔹 1. "Standard Causal Attention"

Causal Attention은 자기보다 앞에 있는 토큰만 볼 수 있도록 제한된 attention

GPT류 모델(예: GPT-4, LLaMA, Claude 등)에서 사용

다음 토큰 예측을 위해 미래 정보는 가려야 함 (unidirectional)

🔹 2. "삼각형의 의미와 토큰 두배 -> 삼각형 면적 4배 의미"

✔ 시각적 은유:

시퀀스를 행렬로 본다면, Attention은 보통 n x n 행렬

Causal Attention에서는 아래처럼 왼쪽 위에서 오른쪽 아래로 펼쳐지는 삼각형 형태가 만들어짐

✔ 시각적으로 보면:

토큰 4개 → 삼각형의 면적: 1 + 2 + 3 + 4 = 10

토큰 8개 → 면적: 1 + 2 + ... + 8 = 36

근사적으로 면적은 (n^2)/2에 비례 → → "삼각형 면적이 4배 증가"는 정확한 비유

출처: Awnihannun, SemiAnalysis

Chunked Attention은 이 삼각형을 고정 크기 블록으로 나눕니다. 각 블록은 attention을 새로운 "첫 번째" 토큰으로 재설정합니다. 줄어든 메모리의 효율성 덕분에 더 긴 맥락을 확보할 수 있습니다. Meta는 긴 맥락을 확보하기 위해 이러한 방식이 필요하다고 생각했지만, 그만한 가치가 없습니다. 각 블록의 첫 번째 토큰은 이전 맥락에 접근할 수 없습니다. 글로벌 attention 계층이 몇 개 있지만, 아래에서 자세히 설명하겠지만 이것만으로는 충분하지 않습니다.

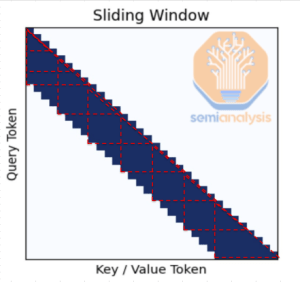

출처: Awnihannun , SemiAnalysis 다른 모델에서 사용되는 슬라이딩 윈도우 어텐션(Sliding Window Attention)은 더 매끄러운 대안을 제공합니다. 어텐션 윈도우가 토큰 단위로 앞으로 슬라이드합니다. 이는 장거리 추론이 맥락을 전파하기 위해 여전히 여러 계층을 필요로 하더라도 지역적 연속성을 유지합니다.

출처: Awnihannun , SemiAnalysis

Behemoth의 Chunked Attention 추적 효율성 구현은 특히 블록 경계에서 사각지대를 초래했습니다. 이는 chain of thought 의 한 Chunked 길이를 초과할 때 모델의 추론 능력 개발 능력에 영향을 미칩니다. 모델은 더 긴 범위에 걸쳐 추론하는 데 어려움을 겪습니다. 돌이켜보면 당연한 것처럼 보일 수 있지만, Meta가 Chunked Attention의 추론 모델 개발에 적합하지 않다는 것을 판단할 수 있는 적절한 장기 맥락 평가나 테스트 인프라조차 구축하지 못했다는 것이 문제의 일부라고 생각합니다. Meta는 강화학습 및 내부 평가에서 매우 뒤처져 있지만, 새롭게 영입된 직원들이 추론 격차를 크게 줄이는 데 도움이 될 것입니다.Expert Choice Routing

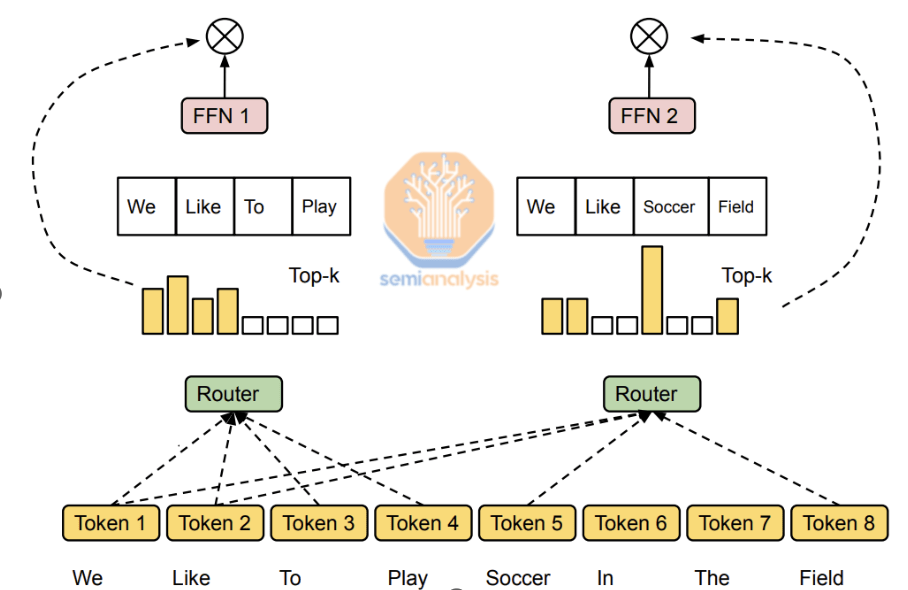

대부분의 최신 LLM은 각 모델 계층 사이에서 토큰이 라우터를 기반으로 여러 전문가에게 라우팅되는 혼합 전문가(Mixture of Experts) 아키텍처를 사용합니다. 최신 MoE 모델에서는 대부분 토큰 선택 라우팅을 사용하여 학습합니다 . 즉, 라우터는 T x E 크기의 텐서를 제공하고(T는 총 토큰 수, E는 MoE 모델의 전문가 수), E 차원에서 topK 소프트맥스를 실행하여 T x K 크기의 텐서를 생성합니다. 이는 라우터가 각 토큰 T에 대해 가장 가능성이 높은 K명의 전문가를 선택하도록 요청받는다는 것을 의미하며, 여기서 K는 한 명 이상의 전문가일 수 있습니다. K는 연구자가 조정할 수 있는 하이퍼파라미터입니다.

출처: 전문가 선택 라우팅을 사용한 전문가 혼합, 그림 1 토큰 선택 라우팅

이 접근 방식의 장점은 각 토큰이 K명의 전문가에 의해 처리되도록 보장되어 각 토큰의 정보 가치가 동일한 수의 전문가에 의해 흡수되도록 한다는 것입니다. 단점은 특정 전문가가 토큰에서 불균형적으로 '인기'를 얻는 반면 다른 전문가는 훈련이 부족하여 각 전문가의 '지능'에 불균형이 발생할 수 있다는 것입니다. 알려진 문제로, 많은 최고 연구실에서 보조 손실( 또는 무손실 ) 부하 분산으로 해결 방법을 개발했습니다. EP(전문가 병렬 처리)로 학습할 때 모델이 여러 GPU 노드에 분산되어 학습 MFU가 낮아질 수 있으며, 이로 인해 스케일업 네트워크(NVLink) 대신 스케일아웃 네트워크(InfiniBand 또는 RoCE)에서 더 많은 콜렉티브(NCCL)가 실행됩니다. 이는 스케일업 네트워크가 표준 8웨이 서버를 넘어 확장되는 NVIDIA의 NVL72 설계에 대한 주요 동기입니다.

Google이 2022년에 도입한 전문가 선택 라우팅은 기존 논리를 뒤집습니다. 전문가가 상위 N개의 토큰을 선택합니다. 라우터에서 생성된 동일한 T x E 텐서를 사용하여, 전문가 선택 라우팅에서는 T 차원에서 상위 N개의 소프트맥스 연산을 실행하여 E x N 텐서를 생성합니다. 이는 E명의 전문가 각각이 라우팅될 확률이 가장 높은 N개의 토큰을 선택했음을 의미합니다. N개의 하이퍼파라미터는 연구자가 조정할 수 있지만, 토큰 선택 라우팅 방식과 비교하기 위해 N = K * T / E로 계산합니다.

출처: 전문가 선택 라우팅을 사용한 전문가 혼합, 그림 1 토큰 선택 라우팅

토큰 선택 라우팅과 직접 비교했을 때, 전문가 선택 라우팅은 전문가가 균형 있게 활성화되도록 보장하여 불균형한 전문가로 인한 성능 저하를 방지합니다. 명확히 하자면, 두 경우 모두 라우터가 선택을 합니다. 토큰 선택 라우팅에서 라우터의 입력은 토큰이며, 전문가를 선택합니다. 전문가 선택 라우팅에서도 라우터의 입력은 전문가이며, 토큰을 선택합니다.

이를 통해 전문가 훈련 부하를 균등하게 분산하고 분산 하드웨어 전반의 MFU(Multi-Functional Function)를 향상시킵니다. 하이퍼스케일러 네트워크는 이러한 병렬 처리를 위해 특별히 설계되었으며, 네트워킹 모델 에서 이를 광범위하게 다룹니다 .

이 접근법의 단점은 토큰 선택 아키텍처와 정반대라는 점입니다. 전문가 선택 라우팅은 특정 '인기' 토큰에 여러 전문가가 참여하는 결과를 초래할 수 있습니다. 이는 토큰 선택 라우팅에서 발생하는 것과 같은 학습 병목 현상을 야기하지는 않지만, LLM이 모든 토큰에 동등하게 주의를 기울이지 않기 때문에 모델 일반화의 저하를 초래할 수 있습니다.

가장 큰 문제는 추론입니다. 추론은 사전 채우기(Prefill)와 디코딩(Decode)의 두 단계로 나뉩니다. 사전 채우기 단계에서는 사용자 프롬프트가 인코딩되어 KV-Cache에 로드됩니다. 이 단계는 플롭 바운드(Flop-bound)입니다. 디코딩 단계에서는 모델이 어텐션을 계산하고 모델의 피드포워드 네트워크를 한 번에 한 토큰씩, 한 번에 한 계층씩 실행합니다.

여기서 전문가 선택 라우팅은 전문가가 레이어당 최대 1개의 토큰 x 배치 크기 중에서만 선택할 수 있기 때문에 어려움을 겪습니다. 결과적으로 각 전문가에게 학습 당시보다 매우 적은 토큰 세트만 제공됩니다(예시 학습 실행은 패스당 8k seqlen x 16 배치 크기 = 128k 토큰). 최신 GPU 네트워킹의 한계로 인해 배치 크기가 추론을 비경제적이고 비효율적으로 만드는 수준으로 제한됩니다.

Meta 는 실행 중간에 전문가 선택 라우팅에서 토큰 선택 라우팅으로 전환했는데, 이로 인해 전문가가 제대로 전문화되지 못했습니다.Data Quality: A Self-Inflicted Wound (데이터 품질: 자초한 상처)

Llama3 405B는 15T 토큰으로 학습되었으며, Llama4 Behemoth는 훨씬 더 많은 토큰, 즉 3~4배 더 큰 토큰이 필요했던 것으로 추정됩니다. 충분히 고품질의 데이터를 확보하는 것은 서구권의 하이퍼스케일러들이 다른 모델의 결과물을 그대로 모방하여 단축할 수 없는 주요 병목 현상입니다.

Llama4 Behemoth 이전에 Meta는 공개 데이터(예: Common Crawl)를 사용했지만, 실행 중에 자체 개발한 내부 웹 크롤러로 전환했습니다. 이 방식이 전반적으로 우수했지만, 역효과도 있었습니다. 팀은 새로운 데이터 스트림을 정리하고 중복을 제거하는 데 어려움을 겪었습니다. 이러한 프로세스는 대규모 스트레스 테스트를 거치지 않았습니다.

더욱이, OpenAI와 Deepseek을 포함한 다른 모든 주요 AI 연구소와 달리 Meta는 YouTube 데이터를 활용하지 않습니다. YouTube 강의 대본과 기타 동영상은 귀중한 데이터 소스이며, Meta는 이러한 데이터 없이는 멀티모달 모델을 구축하는 데 어려움을 겪었을 것입니다.Scaling Experiments (스케일링 실험들)

위의 기술적 문제 외에도, Llama4 팀은 연구 실험을 본격적인 훈련 과정으로 확장하는 데 어려움을 겪었습니다. 연구 방향이 서로 상충되었고, 어떤 방향이 가장 생산적인지 판단할 리더십이 부족했습니다. 특정 모델 아키텍처 선택은 적절한 어블레이션(ablation: 적절한 검증 실험) 없이 모델에 그대로 적용되었습니다. 이로 인해 확장 래더(scaling ladder) 관리가 제대로 이루어지지 않았습니다.

📌 참고:

✔ 훈련 과정으로 확장하는데 어려움의 의미:

여러 팀 또는 연구자들이 각자 다른 방식의 모델 설계나 알고리즘을 제안

하지만 이를 조율하고 명확한 전략을 설정해줄 리더십 부재

결과적으로 팀 전체가 통일된 방향 없이 분산되며 리소스를 비효율적으로 사용

✔ 의미:

Scaling Ladder란:

작은 모델 → 중간 모델 → 대형 모델로 점진적으로 확장해가는 과정

각 단계에서 성능 추이, 학습 안정성, 하이퍼파라미터 튜닝을 관리해야 함

스케일링 실험이 얼마나 어려운지 보여주는 예로, OpenAI의 GPT 4.5 학습 과정을 살펴보겠습니다 . OpenAI의 내부 코드 모노레포는 모델 학습에 매우 중요합니다. OpenAI는 학습 애블레이션을 수행할 때 복잡도를 측정할 검증 데이터셋이 필요하기 때문입니다. 이 데이터셋은 오염되지 않은 것으로 알려져 있습니다. GPT 4.5 학습 실험을 확장하는 동안 모델의 일반화 능력이 향상되는 것을 확인했지만, 실행 도중 모노레포의 일부가 공개된 데이터에서 직접 복사하여 붙여넣은 것임을 깨달았습니다. 모델은 일반화를 하는 것이 아니라 학습 데이터셋에서 암기한 코드를 그대로 반복하고 있었던 것입니다! 대규모 사전 학습을 효과적으로 실행하려면 엄청난 노력과 준비가 필요합니다.

이러한 모든 기술적 문제에도 불구하고 모든 것이 손실된 것은 아닙니다. Meta는 logits 데이터를 더 작고 효율적인 사전 학습된 Maverick 및 Scout 모델로 정제 (distill) 하여, 더 큰 모델의 결함 있는 아키텍처 선택 중 일부를 우회할 수 있었습니다. 증류(Distillation) 는 작은 모델의 경우 강화 학습보다 훨씬 효율적입니다. 하지만 이러한 모델들은 여전히 소스 코드의 한계에 얽매여 있으며, 크기에 비해 동급 최고는 아닙니다.Meta GenAI 2.0 Pt 2: Bridging the Talent Gap (인재 격차 해소)

인프라 개편이 진행 중이고 기술적 교훈을 습득한 Meta의 GenAI 2.0 전략은 이제 초지능의 다음 요소인 인재로 전환됩니다.

마크 저커버그는 선도적인 AI 연구소들과의 인재 격차를 인지하고 채용을 담당했습니다. 그는 규모는 작지만 매우 뛰어난 인재들로 구성된 팀을 구축하는 것을 목표로 하고 있으며, 수천만 달러에 달하는 사이닝 보너스를 무심코 제안하기도 합니다. 목표는 "플라이휠 효과"를 창출하는 것입니다. 최고 수준의 연구원들이 프로젝트에 합류하여 프로젝트에 신뢰와 추진력을 불어넣는 것입니다. 이미 다음과 같은 최근 유명 인사들을 영입하고 있습니다.- Nat Friedman, 전 GitHub CEO

- Alex Wang, 전 Scale AI CEO

- 다니엘 그로스는 일리야 수스트케버의 스타트업 SSI의 CEO이자 공동 창립자였습니다.

채용 전략은 매우 강력합니다. 연구원당 최고 수준의 컴퓨팅, 최고의 오픈소스 모델군 구축 기회, 그리고 20억 명 이상의 일일 활성 사용자(DAU) 에 대한 접근성 이 그 이유입니다. 일반적으로 연구원당 4년간 2억 달러에서 3억 달러에 달하는 연봉 제안 또한 이 전략을 더욱 강화합니다. 이를 통해 Meta는 OpenAI, Anthropic을 비롯한 여러 기업에서 뛰어난 인재를 영입했습니다.

M&A, AI 확장 등

저커버그는 Thinking Machines 과 SSI 모두에 인수 제안을 했지만 거절당했다고 합니다. 일각에서는 저커버그가 Scale AI에 "합의"했다고 지적하지만, 저희는 그렇지 않다고 생각합니다. 앞서 논의했듯이, Llama4 관련 문제의 핵심은 데이터 문제였으며, Scale 인수는 이 문제를 해결하기 위한 직접적인 조치입니다.

Alex는 Scale의 최고 엔지니어들을 대거 영입할 예정이며, 특히 Meta에 절실히 필요한 평가 전문 SEAL 랩을 비롯한 여러 엔지니어들을 영입할 예정입니다. SEAL은 추론 모델 평가의 최고 벤치마크 중 하나인 HLE(Humanity's Last Exam)를 개발했습니다. Nat Friedman과 Daniel Gross가 합류하면서 Meta는 뛰어난 운영진뿐만 아니라 AI 커뮤니티에서 가장 활발하고 존경받는 투자자들을 확보하게 되었습니다. Meta는 최고위층에 매우 유능한 제품 전문가들을 보유하고 있습니다.

원문출처:

https://semianalysis.com/2025/07/11/meta-superintelligence-leadership-compute-talent-and-data/Meta Superintelligence – Leadership Compute, Talent, and Data

Meta’s shocking purchase of 49% of Scale AI at a ~$30B valuation shows that money is of no concern for the $100B annual cashflow ad machine. Despite seemingly unlimited resources, Meta has been fal…

semianalysis.com

반응형'TechStock&Review > AI&Cloud&SW' 카테고리의 다른 글

CUTLASS CuTe 라이브러리와 메모리 주소 Layout (25.8.11) (6) 2025.08.11 GPT-5 출시 와 논란 (25.8.10) (10) 2025.08.10 Kimi K2 오픈소스 모델: 종합 성능 및 아키텍처 분석 (25.7.13) (8) 2025.07.13 프로젝트 Vend: Claude는 작은 가게를 운영할 수 있을까? (25.7.11) (16) 2025.07.11 DeepSeek 출시 128일 이후.. (25.7.8) (8) 2025.07.08